Was ist eigentlich der Kern eines erfolgreichen Datenmigration Leitfaden und warum scheitern laut Gartner über 50 % aller IT-Implementierungsprojekte nicht an der Softwarefunktionalität, sondern an der Qualität der migrierten Daten? Die Antwort liegt oft in der Unterschätzung der historischen Altlasten. Eine Migration ist weit mehr als ein technischer Kopiervorgang von Datenbank A nach Datenbank B. Es ist ein archäologischer Prozess, bei dem Unternehmensgeschichte interpretiert, bereinigt und in eine neue logische Struktur überführt werden muss.

Wenn Sie vor der Aufgabe stehen, ein in die Jahre gekommenes ERP, ein monolithisches HR-System oder eine fragmentierte CRM-Landschaft abzulösen, dann ist dieser Guide Ihr technisches Fundament. Wir beschäftigen uns nicht mit Oberflächen, sondern tauchen tief in die SQL-Ebene, Encoding-Problematiken und ETL-Strategien ein. Denn nur wer seine Daten im Griff hat, kann die PS der neuen Software auch auf die Straße bringen. Für die grundlegende strategische Ausrichtung und die Auswahl der passenden Zielarchitektur sollten Sie unbedingt https://find-your-software.de als Startpunkt nutzen, um sicherzustellen, dass das neue System überhaupt in der Lage ist, Ihre Datenkomplexität abzubilden.

Die Anatomie von Legacy-Daten: Warum „Select *“ nicht reicht

In der Theorie klingt der Export aus Altsystemen trivial: Ein Datenbank-Dump, ein CSV-Export oder eine API-Abfrage. In der Praxis der deutschen IT-Landschaft stoßen wir jedoch auf Systeme, die teilweise seit 15 oder 20 Jahren laufen. Diese Systeme haben „Charakter“ entwickelt – leider oft im negativen Sinne.

Legacy-Systeme zeichnen sich oft durch fehlende referenzielle Integrität auf Datenbankebene aus. Logik wurde früher oft im Application Layer (oder schlimmer: im UI-Client) abgebildet, nicht in der Datenbank. Das Ergebnis: „Verwaiste“ Datensätze, bei denen Bestellpositionen keinen Kopfdatensatz mehr haben, oder Kunden, die keiner Vertriebsregion zugeordnet sind, obwohl das Pflichtfeld im Frontend existiert.

Ein weiteres massives Problem ist die Zweckentfremdung von Feldern. In vielen Unternehmen finden sich „Workarounds“, bei denen das Feld „Faxnummer 2“ missbraucht wurde, um die E-Mail-Adresse der Buchhaltung zu speichern, weil das alte System nur eine E-Mail pro Kontakt zuließ. Ein stumpfer Export würde diese Daten unbrauchbar machen oder im neuen System Validierungsfehler auslösen.

Phase 1: Die forensische Datenanalyse (Data Profiling)

Bevor Sie auch nur eine Zeile Mapping-Code schreiben oder ein ETL-Tool konfigurieren, müssen Sie wissen, womit Sie es zu tun haben. Ein häufiger, fataler Fehler in Migrationsprojekten ist das blinde Vertrauen auf existierende Dokumentationen („Lastenheft 2010_final_v3.docx“). Die harte Realität: Dokumentationen lügen, altern oder bilden nur den „Happy Path“ ab. Datenbanken hingegen sind gnadenlos ehrlich. Sie zeigen jeden Workaround, jeden manuellen Patch und jede strukturelle Sünde der letzten 15 Jahre. Wir sprechen hier von „Data Archeology“: Sie graben nach der Wahrheit hinter den Prozessen.

Quantitative und Qualitative Analyse der Ist-Situation

Ein „Quick Glance“ über die Tabellen reicht nicht. Sie benötigen eine statistisch valide Analyse jedes einzelnen Feldes, das für die Migration in Betracht kommt. Nutzen Sie Tools wie Talend Open Studio, Python (ideal: Pandas Profiling Library) oder komplexe SQL-Analysescripts, um folgende technische Metriken zu erheben:

- Füllungsgrad & „Ghost Values“ (Sparsity): Ein NULL-Check ist nur der Anfang. Prüfen Sie auf funktionale Leere. Ein Feld kann zu 100% gefüllt sein, enthält aber zu 90% den Wert „-„, „n/a“ oder „0“. Die technische Konsequenz: Ein Feld, das im Legacy-System als „Muss-Feld“ definiert war, aber faktisch keine Information trägt, darf im Zielsystem keinesfalls wieder zum Pflichtfeld werden. Dies würde Ihre Prozesse unnötig aufblähen.

- Werteverteilung & Ausreißer (Cardinality & Distribution):

Analysieren Sie die Anzahl der eindeutigen Werte (`DISTINCT COUNT`) im Verhältnis zur Gesamtzeilenzahl.

Beispiel: Im Feld „Länderkennzeichen“ erwarten Sie eine Kardinalität von ca. 200 (ISO-Länder). Finden Sie dort 5.000 Werte, haben Sie ein massives Freitext-Problem („Deutschland“, „D“, „GER“, „Germany“, „Deutschland (Bayern)“). Ohne eine vorherige Normalisierungstabelle (Mapping-Lookup) wird der Import im neuen System scheitern. - Mustererkennung & Validierung (Pattern Matching):

Hier hilft oft nur Regular Expression (Regex). Entsprechen alle E-Mail-Adressen dem RFC 5322 Standard? Oft finden sich in E-Mail-Feldern Einträge wie „keine@mail.de“ oder „info@kunde.de (bitte Fr. Müller verlangen)“.

Das Risiko: Moderne CRMs validieren E-Mails oft beim Import oder Versand. Solche „schmutzigen“ Daten führen zu Hard Bounces und blockieren den Import-Batch. - Verwaiste Datensätze (Orphaned Records):

In alten SQL-Datenbanken fehlen oft `FOREIGN KEY CONSTRAINTS`. Das bedeutet, Sie haben Bestellpositionen, deren Kopfdatensatz (Bestellung) längst gelöscht wurde.

Die Analyse: Führen Sie `LEFT JOIN`-Abfragen durch, um Datensätze ohne „Eltern“ zu identifizieren (`WHERE parent.id IS NULL`). Diese Daten müssen vor dem Export eliminiert oder einem „Dummy-Parent“ zugeordnet werden.

Diese forensische Analyse ist oft der entscheidende „Pivot Point“ im Projekt. Sie liefert die empirische Grundlage für die Entscheidung, ob eine Migration der historischen Daten wirtschaftlich überhaupt sinnvoll ist. Eine detaillierte Entscheidungshilfe hierzu finden Sie im Artikel ERP-Upgrade oder Ablösung: So treffen Sie die richtige Entscheidung. Oft zeigt das Profiling, dass die alte Datenstruktur (z.B. flache Hierarchien) so inkompatibel zu modernen Prozessen (z.B. matrixbasierten Genehmigungsworkflows) ist, dass nur eine „Greenfield“-Migration (Neuaufbau) ohne Historie sinnvoll ist.

Zwischenschritt: Die „Source-to-Target“ Matrix (STM)

Der häufigste Grund für Missverständnisse zwischen dem Fachbereich (Business) und den ETL-Entwicklern ist das Fehlen einer präzisen, bindenden Spezifikation. Ein einfaches „Wir übernehmen die Kundendaten“ ist keine Arbeitsanweisung. Bevor eine Zeile ETL-Code geschrieben wird, muss die Source-to-Target Matrix (STM) stehen. Sie ist der „Vertrag“ der Migration.

Dies ist meist ein komplexes, lebendes Dokument (oft Excel oder Confluence), das die Transformationslogik auf Feldebene definiert. Es muss technische Datentypen (Casting) ebenso berücksichtigen wie Business-Logik.

| Source (Alt-System) | Type (Alt) | Target (Neu-System) | Type (Neu) | Transformation Logic & Rules | Data Owner |

|---|---|---|---|---|---|

KND_NAME_1 + KND_NAME_2 |

VARCHAR(50) |

Account.Name |

STRING(255) |

Concatenate with Space. TRIM() Whitespaces. Check length < 255. If KND_NAME_1 is empty, Skip Row (Log Error). |

Sales |

STATUS_ID |

INT |

Account.Status |

ENUM |

Lookup Mapping: 0 → ‚Active‘ 1 → ‚Inactive‘ 9 → ‚Archived‘ Else: Set to ‚Review_Pending‘ | IT / MDM |

UMSATZ_VJ |

VARCHAR |

Revenue_Prev_Year |

DECIMAL(10,2) |

Replace ‚,‘ with ‚.‘. Remove currency symbols (€). Cast to Decimal. If conversion fails → NULL. |

Finance |

Ohne diese „Rosetta Stone“-Übersetzung wird der Programmierer raten – und er wird falsch raten. Ein VARCHAR, das eigentlich eine Zahl enthält, führt beim Import in ein DECIMAL-Feld sofort zum Abbruch, wenn auch nur ein Datensatz ein Leerzeichen enthält. Die STM zwingt Sie, diese Fälle vor dem ersten Testlauf zu definieren.

Strategische Planung: Big Bang vs. Inkrementell (Phased)

Die Wahl der Migrationsstrategie ist keine reine Projektmanagement-Entscheidung („Wann gehen wir live?“), sondern eine fundamentale Architekturentscheidung. Sie bestimmt das Design Ihrer ETL-Strecken, die Notwendigkeit von Middleware und die Komplexität Ihrer Fallback-Szenarien.

Technisch gesehen müssen Sie entscheiden, wie lange Sie in einer hybriden Umgebung leben können und wollen. Während der Business-Case oft eine schnelle Ablösung fordert, diktiert die Datenintegrität oft das Tempo.

Technischer Deep-Dive: Die Migrationspfade

1. Die Big Bang Strategie („Cold Cutover“)

Das Altsystem wird am Freitag um 17:00 Uhr in den „Read-Only“-Modus versetzt. Über das Wochenende laufen die ETL-Jobs. Am Montag um 08:00 Uhr geht das Neusystem live.

- Technische Anforderung: Extreme Performance. Sie müssen ggf. Terabytes an Daten in einem 48-Stunden-Fenster transformieren und laden. Das erfordert parallele Threads, deaktivierte Indizes während des Inserts und massive Hardware-Ressourcen für das Wochenende.

- Der „Point of No Return“: Sie müssen einen exakten Zeitpunkt definieren (z.B. Sonntag, 14:00 Uhr), an dem entschieden wird: Go oder Rollback? Ein Rollback bedeutet hier: Restore der alten Datenbank-Backups und Wiederaufnahme der Arbeit im Altsystem.

2. Die Inkrementelle Migration (The „Strangler Fig Pattern“)

Angelehnt an das Software-Design-Pattern von Martin Fowler, bei dem das neue System das alte langsam „überwuchert“ und ersetzt. Sie migrieren beispielsweise erst die Stammdaten (Customer Master), während die Transaktionen (Orders) noch im Altsystem laufen.

- Technische Hölle: Bi-Direktionale Synchronisation.

Das ist die größte technische Hürde. Wenn ein Kunde im neuen CRM seine Adresse ändert, muss diese Information in Echtzeit („Real-time Sync“) oder per Batch („Nightly Sync“) in das alte ERP zurückgespielt werden, damit dort Lieferscheine gedruckt werden können. - Data Consistency: Sie benötigen eine komplexe Middleware (ESB oder iPaaS), die Konflikte löst. (Was passiert, wenn derselbe Datensatz zeitgleich in Alt und Neu geändert wird? → „Last Write Wins“ oder manuelle Konfliktlösung?)

Vergleichstabelle für Architekten

| Feature | Big Bang | Inkrementell / Phased |

|---|---|---|

| Schnittstellen-Aufwand | Niedrig (Nur One-Way Export) | Exorbitant (Two-Way Sync, API-Bridge) |

| Rollback-Strategie | Full Restore (Alles oder Nichts) | Granular (Modul-Rollback möglich) |

| Testing | Erfordert komplette „Mock Cutovers“ (Generalproben) unter Vollast. | Erfordert komplexe End-to-End Tests über Systemgrenzen hinweg. |

| Datenqualität | Muss zum Stichtag 100% sauber sein. | Kann sukzessive pro Modul bereinigt werden. |

Unabhängig von der gewählten Strategie benötigen Sie frühzeitig Klarheit über die Kapazitäten des Zielsystems. Nutzen Sie spezialisierte Plattformen wie https://find-your-erp.de/ für komplexe Unternehmensressourcen, um zu prüfen, ob die Software überhaupt eine phasenweise Einführung („Side-by-Side Szenario“) unterstützt.

Gerade im HR-Bereich (https://find-your-hr.de/) ist der „Big Bang“ oft alternativlos, da Gehaltsabrechnungen konsistent sein müssen – Sie können einen Mitarbeiter nicht „halb“ im neuen System abrechnen. Ein modernes Cloud-ERP hat völlig andere Anforderungen an Datenkonsistenz und API-Limits als ein On-Premise-System aus den 2000ern, was die inkrementelle Synchronisation oft technisch limitiert (API-Throttling).

Phase 2: Data Cleansing – Die Hygiene vor dem Umzug

„Garbage In, Garbage Out“ ist das Mantra jeder Migration. Doch die Realität ist härter: Wenn Sie schlechte Daten in ein modernes, automatisiertes System migrieren, beschleunigen Sie nur die Geschwindigkeit, mit der falsche Entscheidungen getroffen werden. Ein Workflow, der früher manuell von einem Sachbearbeiter korrigiert wurde („Ach, das ist wieder der Müller aus München, da fehlt die Hausnummer“), läuft im neuen System auf einen Fehler (Exception) und stoppt den Prozess.

Die „1-10-100 Regel“ der Datenqualität

Ökonomisch betrachtet ist die Migration der „Sweet Spot“ für die Bereinigung. Die Faustregel besagt: Die Korrektur eines Datensatzes kostet 1 € bei der Eingabe (Validierung), 10 € bei der Bereinigung (Cleansing im Batch) und 100 €, wenn der Fehler im operativen Betrieb auftritt (z.B. Rückläufer, falsche Rechnungsstellung, Reputationsschaden).

Standardisierung, Deduplizierung und „Golden Record“

In vielen Legacy-Systemen existieren Kunden mehrfach (Redundanz) und in unterschiedlichen Formaten (Inkonsistenz).

- Standardisierung (Normalization): Bevor Sie vergleichen, müssen Sie normieren.

Beispiel: Telefonnummern in E.164 Format konvertieren (`+49…`), „Str.“ zu „Straße“ ausschreiben, Ländercodes auf ISO-3166-1 alpha-2 (`DE`, `AT`) mappen. Erst wenn die Struktur gleich ist, kann der Vergleich beginnen. - Deduplizierung (Matching): Identifikation von Dubletten. Hier reicht ein einfacher SQL-Vergleich (`WHERE name = name`) nicht aus.

Die Lösung: Nutzen Sie Fuzzy-Logic und phonetische Algorithmen:- Levenshtein-Distanz: Misst die Anzahl der Zeichenänderungen (Edits), um aus „Müller“ „Mueller“ zu machen. Gut für Tippfehler.

- Soundex / Kölner Phonetik: Reduziert Worte auf ihren Klang. „Maier“, „Mayer“ und „Meier“ erhalten denselben phonetischen Code.

- Jaro-Winkler: Priorisiert Übereinstimmungen am Anfang des Strings (wichtig bei Vornamen/Nachnamen).

Survivorship-Regeln: Wer darf überleben?

Wenn Sie drei Datensätze zu einem „Golden Record“ verschmelzen, welche Information gewinnt? Sie benötigen technische Survivorship-Regeln im ETL-Prozess:

- Most Recent: „Nimm die Adresse vom Datensatz mit dem jüngsten `Last_Modified_Date`.“

- Most Complete: „Nimm den Datensatz, bei dem E-Mail UND Telefon gefüllt sind.“

- Trusted Source: „Daten aus dem Buchhaltungssystem (SAP FI) überschreiben immer Daten aus dem Marketing-Tool (Newsletter).“

Aber Vorsicht: Automatisierung hat Grenzen. Definieren Sie Confidence Thresholds.

• Match > 95%: Automatischer Merge.

• Match 70-95%: Flag für „Data Steward“ (manuelle Prüfung).

• Match < 70%: Als separater Datensatz behandeln.

Use Case: ESG-Reporting im Mittelstand

Das Szenario: Ein Zulieferer der Automobilindustrie muss für sein neues ESG-Reporting (https://find-your-esg.de/) CO2-Daten (Scope 3 Emissionen) seiner Lieferkette nachweisen.

Das Problem: Im Altsystem waren Lieferanten oft nur als unstrukturierter Freitext in Bestellungen hinterlegt („Taxifahrt Berlin“, „Hotel Müller“), ohne saubere Stammdatenverknüpfung oder USt-ID. Eine Berechnung des Carbon Footprints war unmöglich, da keine Zuordnung zu Emissionsfaktoren erfolgen konnte.

Die Lösung: Vor der Migration wurde eine Data Enrichment Pipeline gebaut.

1. Extraktion aller Lieferantennamen.

2. Abgleich gegen externe Datenbanken (z.B. Dun & Bradstreet oder Handelsregister-APIs).

3. Anreicherung mit eindeutigen IDs (D-U-N-S Nummer) und Branchencodes (NACE/SIC).

Erst diese angereicherten, validierten Objekte wurden ins neue ESG-Tool importiert. Das Ergebnis: Ein automatisiertes Dashboard statt manueller Excel-Hölle.

Phase 3: ETL-Design und Mapping-Logik

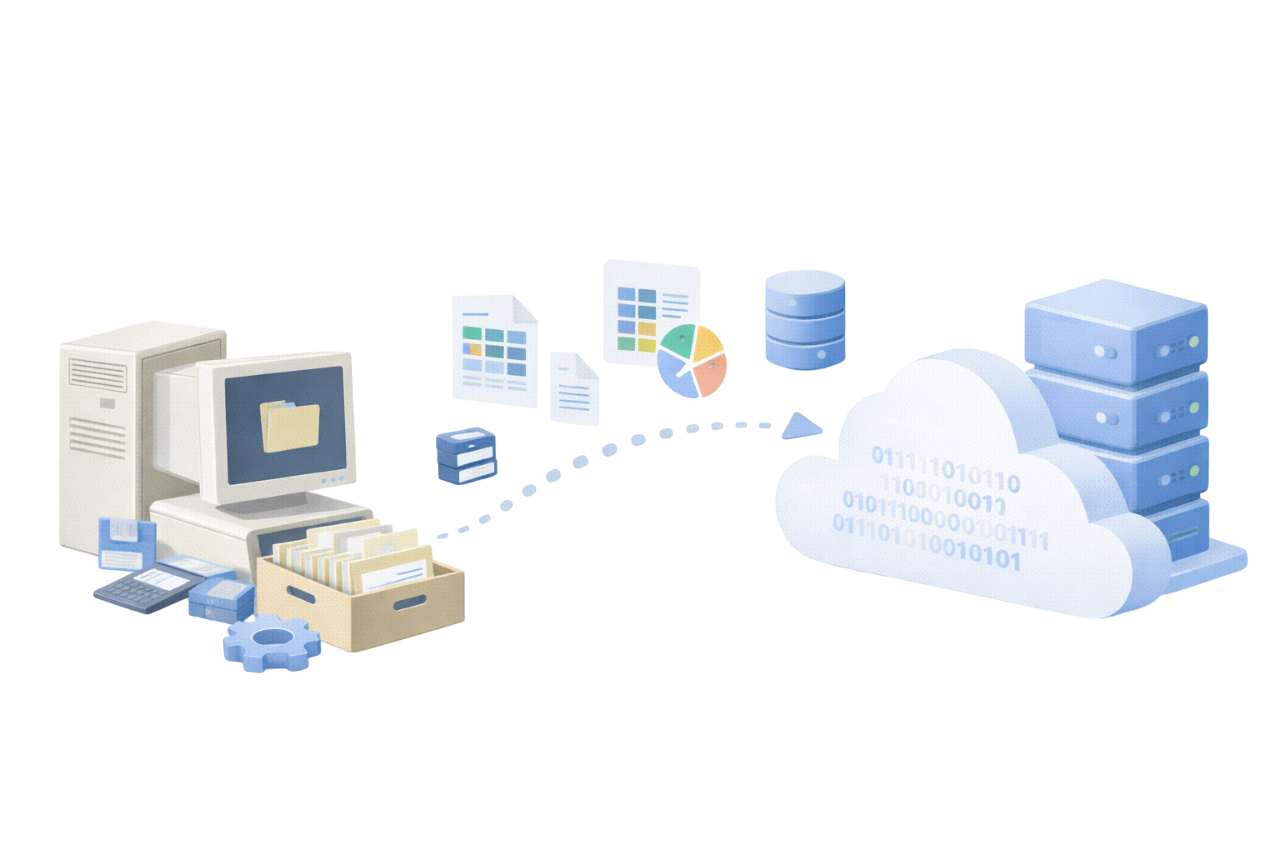

Der ETL-Prozess (Extract, Transform, Load) ist das technische Herzstück jeder Migration. Hier entscheidet sich, ob Ihre Daten im neuen System nutzbar sind oder ob Sie nur „Chaos in der Cloud“ erzeugen.

In professionellen Migrationsprojekten arbeiten wir selten direkt von „Quelle zu Ziel“. Stattdessen etablieren wir eine Staging Area (Zwischenspeicher-Datenbank).

Der Flow ist: Legacy DB → Raw Staging (1:1 Kopie) → Clean Staging (Transformiert) → Target API.

Warum? Weil Sie den Extraktionsprozess vom Transformationsprozess entkoppeln müssen. Wenn Ihre Transformation fehlschlägt, wollen Sie nicht erneut das Altsystem belasten (das vielleicht im produktiven Betrieb ist), sondern nur den Staging-Prozess neu starten.

Herausforderung: Historisierung und die „Open Item“-Strategie

Ein häufiger Fehler, getrieben durch Angst vor Informationsverlust, ist der Versuch, die gesamte transaktionale Historie zu migrieren. Fragen Sie sich kritisch: Müssen Sie wirklich jede Lagerbewegung (Inventory Movement) von 2012 im neuen System haben? Die Antwort ist technisch und kaufmännisch fast immer: Nein.

Wir nutzen hierfür die „Cut-Off“-Strategie (Stichtagsbetrachtung):

- Stammdaten (Master Data): Werden vollständig migriert (Kunden, Artikel, Stücklisten, Arbeitspläne).

- Bewegungsdaten (Transactional Data): Hier migrieren wir nur die „Open Items“ (Offene Posten).

- Finance: Nur unbezahlte Rechnungen. Abgeschlossene Jahre werden als Saldenvortrag (Opening Balance) gebucht.

- Sales: Nur offene Aufträge, die noch nicht geliefert/fakturiert sind.

- Logistik: Nur aktueller Lagerbestand zum Stichtag (Inventur), keine historischen Zu-/Abgänge.

- Historie (Audit Trail): Wird nicht operativ migriert. Altdaten werden in ein Data Warehouse (DWH) oder ein schreibgeschütztes Archiv-System (z.B. GDPdU-konformer Export) verschoben. Das entlastet das neue System massiv und reduziert die Komplexität des Mappings um oft 80 %.

Technische Fallstricke: Encoding, BOM und „Mojibake“

Ein technisches Detail, das Projekte um Wochen verzögern kann: Zeichenkodierung. Alte AS/400, IBM iSeries oder Mainframe-Systeme nutzen oft EBCDIC. Ältere Windows-SQL-Server nutzen oft Windows-1252 oder ISO-8859-1.

Moderne Web-Applikationen, REST-APIs und JSON-Payloads erwarten striktes UTF-8.

Das Risiko: Wenn Sie beim Export oder in der Staging-Datenbank nicht explizit transkodieren (z.B. via `iconv` unter Linux), entstehen sogenannte „Mojibake“ (Datensalat). Aus „Müller“ wird „Müller“. Schlimmer noch: Unsichtbare Steuerzeichen (Control Characters, z.B. Vertical Tab `\v` oder Null-Bytes `\0`) können XML/JSON-Parser im Zielsystem zum Absturz bringen.

Die Lösung: Das „Toxic Dataset“:

Erstellen Sie für Ihre ETL-Tests einen synthetischen Datensatz, der alle Edge-Cases enthält:

Teststring: "Müller & Co. < > ' ` € @ \n \r Emoji: 🚀 Chinese: 汉字".

Wenn dieser String im Zielsystem exakt so ankommt und nicht als < (Double Escaping) oder ???? (Replacement Character) endet, ist Ihre Pipeline robust.

Der blinde Fleck: Unstrukturierte Daten (BLOBs & Anhänge)

Oft konzentrieren sich Teams zu 100 % auf strukturierte Daten (SQL-Tabellen) und vergessen die 2 Terabyte an PDFs, CAD-Zeichnungen, Lieferschein-Scans und E-Mails, die an den Datensätzen „hängen“.

Legacy-Systeme speichern Dateien oft direkt in der Datenbank als BLOB (Binary Large Object) oder als lokalen, absoluten Dateipfad (C:\ERP_Data\Files\2010\Rechnung.pdf). Beides ist in modernen Cloud-Architekturen fatal. Cloud-Datenbanken sind zu teuer für BLOB-Speicherung, und lokale C:\ Pfade existieren in der Cloud nicht.

Die „Detach & Link“ Strategie:

- Extraktion & Upload: Ein Skript extrahiert die Binärdaten und lädt sie in einen günstigen Object Storage (AWS S3, Azure Blob, Google Cloud Storage).

- Re-Linking: Die Datenbank speichert nicht mehr die Datei, sondern nur noch die URL oder URI zum Objekt (z.B.

s3://my-bucket/documents/inv-123.pdf). - Zeitfaktor (Latency): Unterschätzen Sie die Physik nicht. Der Upload von 1 Million kleinen PDF-Dateien ist extrem langsam (Latenz pro Request).

Pro-Tipp: Starten Sie diesen „Pre-Load“ Wochen vor dem Go-Live. Beim eigentlichen Cutover müssen dann nur noch die Delta-Dateien der letzten Tage hochgeladen werden.

Idempotenz: Die Versicherung gegen Abstürze

Ihr ETL-Prozess wird abstürzen. Das ist keine Frage des „Ob“, sondern des „Wann“ (Netzwerkabbruch, API-Timeout).

Wichtig ist, dass Ihre Skripte idempotent sind. Das bedeutet: Wenn Sie das Skript zweimal laufen lassen, darf der Datensatz nicht zweimal angelegt werden.

Nutzen Sie statt einfacher INSERT-Befehle immer UPSERT-Logiken (Update or Insert):

„Wenn die Legacy-ID ‚123‘ schon existiert → Aktualisiere die Felder. Wenn nicht → Lege neu an.“

Dies erfordert, dass Sie im Zielsystem ein Feld für die Legacy_External_ID vorhalten, um den Datensatz zweifelsfrei wiederzuerkennen.

Phase 4: Compliance, DSGVO und der „Recht auf Vergessenwerden“-Check

Eine Migration ist der perfekte (und oft einzige) technische Hebel, um datenschutzrechtlich „Tabula Rasa“ zu machen. In laufenden Systemen werden Löschkonzepte oft jahrelang ignoriert („Der Button ‚Löschen‘ ist ausgegraut, weil wir die Historie brauchen“).

Bei einer Migration greift jedoch Art. 17 DSGVO (Recht auf Löschung) mit voller Härte. Sie dürfen personenbezogene Daten (PII – Personally Identifiable Information) nicht in ein neues System übertragen, wenn der ursprüngliche Zweck der Verarbeitung (z.B. eine Bewerbung von 2014 oder ein Kaufvertrag von 2010) entfallen ist und keine gesetzliche Aufbewahrungsfrist mehr besteht.

Die „Data Minimization“ Strategie (Art. 5c DSGVO)

Technisch bedeutet dies: Ihr ETL-Prozess muss als Filter fungieren, nicht als Rohrleitung.

Implementieren Sie Löschregeln (Retention Policies) direkt in die SQL-Queries der Extraktionsschicht (`WHERE clause`).

- Hard Delete: Physisches Nicht-Migrieren von Datensätzen. (Risiko: Referenzielle Integrität in historischen Reports bricht).

- Anonymisierung: Überschreiben von PII-Feldern mit

NULLoder'ANONYMIZED', während die IDs und Metadaten (z.B. „Bestelldatum“, „Warenkorbwert“) erhalten bleiben. Dies rettet Ihre statistischen Auswertungen („Umsatz 2015“), ohne Datenschutzverstöße zu begehen.

Use Case: Bereinigung von Bewerberdaten (HR)

Das Szenario: Ein Unternehmen migriert auf eine neue Talent-Management-Suite. Im alten System befinden sich 50.000 Bewerberdatensätze aus den letzten 10 Jahren, inklusive PDF-Lebensläufen.

Die Compliance-Falle: Nach AGG (Allgemeines Gleichbehandlungsgesetz) müssen Bewerberdaten in Deutschland in der Regel 6 Monate nach Ablehnung gelöscht werden, sofern keine Einwilligung für einen Talent-Pool vorliegt. Das Altsystem hatte keine automatische Löschroutine.

Die Lösung: Im ETL-Prozess wurde ein komplexes Regelwerk implementiert:

IF (Candidate.Status == 'Rejected' AND Candidate.Last_Interaction < NOW() - 6 Months AND Candidate.Talent_Pool_Consent == FALSE) THEN SKIP ROW & DELETE BLOB.

Nur aktive Bewerber oder solche mit explizitem, gültigem Opt-In wurden in das neue System auf find-your-hr.de-Basis übernommen.

ROI-Effekt: Da moderne HR-SaaS-Lösungen oft pro Datensatz (Candidate Record) lizenzieren, sparte diese Bereinigung dem Kunden 40 % der jährlichen Lizenzkosten.

Consent-Migration: Der unterschätzte Metadaten-Albtraum

Ein häufiger Fehler im CRM-Umfeld: Sie migrieren die E-Mail-Adresse, aber vergessen den Nachweis der Einwilligung (Double Opt-In Zeitstempel & IP-Adresse).

Ohne diesen Metadatensatz ("Wann hat der Kunde zugestimmt?") ist die E-Mail-Adresse im neuen Marketing-Automation-Tool wertlos, da Sie sie rechtssicher nicht anschreiben dürfen.

Best Practice: Mappen Sie Consent-Informationen in dedizierte Compliance-Objekte im Zielsystem, nicht in einfache Checkboxen ("Newsletter: Ja").

Testdaten-Management: Die Gefahr der "echten" Kopie

Entwickler lieben es, mit einem "Full Copy" der Produktionsdaten zu testen. Datenschutzbeauftragte hassen es.

Wenn Sie echte Kundendaten in eine ungesicherte Testumgebung (Sandbox) migrieren, ist das oft bereits ein Data Breach.

Nutzen Sie Data Masking oder Obfuskation während des Transits in Testumgebungen:

- Scrambling: Zeichen werden zufällig vertauscht.

- Hashing: Aus "Max Mustermann" wird ein Hashwert.

- Synthetic Data: Generierung künstlicher Profile, die statistisch den echten Daten ähneln, aber keinen Personenbezug haben.

Nutzen Sie zudem Standards wie die ISO 8000 (Data Quality) und ISO/IEC 27001 (Information Security), um objektive Kriterien für den Erfolg Ihrer Bereinigung und Sicherheit zu definieren.

Phase 5: Import, Validierung und "Go-Live" – Die Stunde der Wahrheit

Der Import in das Zielsystem ("Target Load") erfolgt heute so gut wie nie direkt auf Datenbankebene via SQL-Injection (`INSERT INTO...`). Dies wäre ein architektonisches Himmelfahrtskommando, da es die gesamte Business-Logik (Trigger, Validierungsregeln, Workflows, Audit-Logs) der neuen Software umgeht.

Stattdessen nutzen wir die Application Layer: REST/SOAP APIs oder dedizierte Import-Frameworks der Hersteller (z.B. Salesforce Bulk API, SAP Migration Cockpit). Das garantiert Datenkonsistenz, hat aber einen Preis: Performance.

Performance Engineering: API-Limits und Durchsatzraten

Unterschätzen Sie die Physik der Netzwerklatenz nicht. Eine einfache synchrone REST-API, die für Einzeltransaktionen gebaut wurde, schafft vielleicht 2-5 Calls pro Sekunde.

Die Mathematik des Scheiterns:

Bei 1 Million Datensätzen und 0,5 Sekunden Latenz pro Call benötigen Sie knapp 6 Tage (138 Stunden) für den Import. Das sprengt jedes Wochenend-Fenster ("Cutover-Weekend").

Die Lösung: Asynchrone Bulk-APIs & Parallelisierung

- Bulk-Processing: Nutzen Sie APIs, die Batches (z.B. 10.000 Records pro CSV-Chunk) akzeptieren. Der Server verarbeitet diese asynchron im Hintergrund.

- Parallelisierung (Multi-Threading): Feuern Sie mehrere Batches gleichzeitig ab. Aber Vorsicht: Beachten Sie die Rate Limits (HTTP 429 "Too Many Requests") des Zielsystems. Ein zu aggressives Skript wird vom Cloud-Provider temporär gesperrt (Throttling).

- Sequenzierung: Importieren Sie in der logisch korrekten Reihenfolge, um "Missing Parent"-Fehler zu vermeiden. (Erst Accounts, dann Kontakte, dann Tickets).

Validierung: Vom "Count Check" zum "Reconciliation Report"

Der Satz "Wir haben 10.000 rein, 10.000 raus" ist das Minimum, aber kein Qualitätsbeweis. Wir unterscheiden drei Ebenen der Validierung:

Level 1: Syntaktische Prüfung (Counts & Nulls)

Stimmen die Zeilenanzahlen überein? Sind Pflichtfelder gefüllt? Dies fangen moderne ETL-Tools meist automatisch ab.

Level 2: Semantische Prüfung (Business Logic)

Hier wird es komplex.

Beispiel: Im Altsystem war der Kunde "Inaktiv". Im Neusystem gibt es diesen Status nicht, er wurde auf "Hold" gemappt. Kann man für einen "Hold"-Kunden noch Aufträge anlegen?

Diese Logikfehler finden Sie nur durch User Acceptance Tests (UAT). Lassen Sie Key-User aus den Fachabteilungen (Sales, HR, Finance) dedizierte Test-Szenarien ("User Stories") im neuen System mit migrierten Daten durchspielen.

Level 3: Finanzielle Abstimmung (Reconciliation)

Bei Finanzdaten (Offene Posten, Salden) reicht Stichprobenprüfung nicht. Hier gilt: Zero-Difference-Policy.

- Hash-Summen-Vergleich (Checksums): Bilden Sie Hashwerte über kritische Zeileninhalte (z.B. `MD5(KundenID + Rechnungsdatum + Betrag)`). Vergleichen Sie die Hash-Liste der Quelle mit dem Ziel. Jede Abweichung zeigt eine Datenkorruption an.

- Aggregats-Vergleich: Die Summe aller offenen Forderungen im Altsystem (z.B. 14.503.201,45 €) muss auf den Cent genau der Summe im Neusystem entsprechen. Differenzen durch Rundungsfehler bei Währungsumrechnungen sind der häufigste Stolperstein.

Das "Runbook": Der militärische Fahrplan für den Go-Live

Ein Go-Live darf keine Improvisationsveranstaltung sein. Erstellen Sie ein Cutover Runbook, das den Ablauf im Minutentakt regelt:

- T-Minus 48h: Full Backup des Altsystems. Einfrieren der Benutzerzugänge (Read-Only Mode).

- T-Minus 24h: Start der ETL-Strecken für Stammdaten.

- T-Minus 12h: Delta-Load der Bewegungsdaten (letzte Bestellungen seit dem letzten Full-Load).

- T-Minus 4h: Validierung und Smoke-Tests durch IT.

- T-Minus 2h: "Go / No-Go" Meeting mit dem Management.

- T-Zero: Freischaltung der DNS-Einträge und Login für User.

Planen Sie für den "Hypercare"-Support in der ersten Woche nach Livegang doppelte Besetzung im IT-Helpdesk ein. Irgendetwas wird schiefgehen – entscheidend ist, wie schnell Sie reagieren.

Management und "Human Factor": Die Psychologie der Daten

Technisch ist eine Migration oft ein lösbares Puzzle aus SQL und API-Calls. Organisatorisch ist es ein Minenfeld. Datenmigration ist hochpolitisch, denn Daten sind Macht und Sicherheit. Abteilungen "klammern" sich emotional an ihre Historie.

Der Vertriebsleiter wird darauf bestehen, jeden Kontakt aus dem Jahr 2005 zu behalten ("Man könnte ihn ja nochmal brauchen"), auch wenn die Firma seit 2012 insolvent ist. Die Buchhaltung wird fordern, Hilfskostenstellen zu migrieren, die seit zehn Jahren nicht bebucht wurden.

Data Governance: IT liefert das Rohr, das Business das Wasser

Ein häufiges Missverständnis: "Die IT macht die Migration." Das ist falsch. Die IT stellt die Infrastruktur (ETL-Tools, Skripte) zur Verfügung. Die Verantwortung für den Inhalt (Content) und die Qualität muss zwingend beim Fachbereich liegen.

Etablieren Sie ein Data Governance Board und definieren Sie Verantwortlichkeiten glasklar nach der **RACI-Matrix** (Responsible, Accountable, Consulted, Informed):

- Data Owner (Accountable): Meist der Abteilungsleiter (z.B. Head of Sales). Er entscheidet strategisch: "Wir migrieren nur Kunden mit Umsatz > 0 in den letzten 3 Jahren." Er unterschreibt das Abnahmeprotokoll.

- Data Steward (Responsible): Der operative Experte (z.B. Key User Sales). Er prüft die Dublettenlisten, definiert die Mapping-Regeln für Kundengruppen und führt die UATs (User Acceptance Tests) durch.

- IT / Migration Architect (Consulted): Führt die technische Umsetzung durch und berät zur Machbarkeit ("Wir können das Feld nicht mappen, weil die Datentypen inkompatibel sind").

Nutzen Sie Frameworks wie DAMA-DMBOK (Data Management Body of Knowledge), um diese Rollen formal zu definieren. Ohne ein schriftliches "Sign-off" des Data Owners vor dem Go-Live laufen Sie Gefahr, dass jeder Datenfehler im neuen System auf die "unfähige IT" geschoben wird.

Die "Angst-Archive": Ein psychologischer Trick

Um den Widerstand gegen das Löschen alter Daten zu brechen, nutzen wir oft die "Cold Storage"-Strategie:

"Wir löschen nichts. Wir verschieben die alten Daten nur in ein lesbares Archiv (z.B. PDF-Exports oder eine schreibgeschützte SQL-Datenbank), auf das ihr jederzeit zugreifen könnt."

Erfahrungsgemäß greift nach 3 Monaten niemand mehr auf dieses Archiv zu, aber die psychologische Sicherheit ("Ich könnte, wenn ich wollte") ermöglicht erst die Bereinigung des operativen Systems.

Der Notfallplan: Rollback, RPO und der "Point of No Return"

Auch mit der besten Planung (Runbooks, Dry-Runs) kann am Go-Live-Wochenende das Unvorhersehbare passieren. Ein kritischer Server im Rechenzentrum fällt aus, ein API-Zertifikat ist abgelaufen oder die Datenkorruption wird erst bei 50 % des Imports bemerkt.

Ein Go-Live ohne definierten Ausstiegsprozess ist fahrlässig. Sie benötigen ein militärisch geplantes Cutover-Szenario.

Die Go/No-Go Checkpoints (Quality Gates)

Definieren Sie im Vorfeld feste zeitliche und qualitative Meilensteine für das Migrations-Wochenende.

- Checkpoint 1 (Freitag, 22:00): Extraktion abgeschlossen. Prüfsummen (Hash-Werte) Quellsystem vs. Staging Area stimmen überein? → Go/No-Go.

- Checkpoint 2 (Samstag, 14:00): Stammdaten-Import (Kunden, Material) im Zielsystem erfolgreich? Fehlerrate < 0,1%? → Go/No-Go.

- Checkpoint 3 (Sonntag, 10:00 - Point of No Return): Bewegungsdaten (offene Posten) importiert. Finanz-Abstimmung (Reconciliation) erfolgreich? Ab hier gibt es oft kein Zurück mehr ohne massiven Datenverlust.

Strategien für den Notfall: Rollback vs. Fix-Forward

Wenn ein Fehler auftritt, haben Sie zwei Optionen, die von Ihrer **RTO (Recovery Time Objective)** abhängen:

Option A: Der Rollback (Rückabwicklung)

Das neue System wird nicht freigeschaltet. Das Altsystem (Legacy) wird reaktiviert.

Voraussetzung: Das Altsystem war während des Wochenendes im strikten "Read-Only"-Modus oder Sie haben funktionierende Snapshots/Backups vom Freitagabend.

Das Risiko: Image-Schaden und Kosten. Aber besser ein verschobener Go-Live als ein stehender Betrieb am Montagmorgen.

Option B: Fix-Forward (Flucht nach vorn)

Der Fehler ist kritisch, aber isolierbar (z.B. "Nur die Historie der E-Mail-Adressen bei Ansprechpartnern ist fehlerhaft, aber Rechnungen können geschrieben werden").

Die Entscheidung: Man geht live und akzeptiert den Fehler ("Known Issue"), um den Geschäftsbetrieb nicht zu gefährden. Ein "Hotfix-Team" bereinigt die Daten am Montag per Update-Skript direkt in der Datenbank oder per API-Korrektur.

Wichtig: Diese Entscheidung darf niemals die IT allein treffen. Der Data Owner muss das Risiko ("Können wir Montag arbeiten?") bewerten und freigeben.

Nichts ist teurer als ein halbgares System "auf Biegen und Brechen" live zu schalten, nur um das Gesicht zu wahren. Ein professioneller Rollback ist keine Schande, sondern ein Beweis für funktionierendes Risikomanagement.

Fazit: Vom "notwendigen Übel" zum strategischen Asset-Management

Wer eine Datenmigration lediglich als technisches "Copy-Paste-Manöver" betrachtet, um ein neues System einzuschalten, vergibt die größte Chance der digitalen Transformation. In der Realität ist die Migration die aggressivste Maßnahme zur Reduktion von Technical Debt (technischen Schulden), die ein Unternehmen durchführen kann.

Wir leben in einer Zeit, in der Daten das neue Öl sind ("Data Gravity"). Doch verunreinigtes Öl verstopft den Motor. Wenn Sie unbereinigte Legacy-Daten in ein modernes Cloud-ERP oder CRM migrieren, zerstören Sie den ROI der neuen Software bereits am Tag 1. Moderne Features wie AI-gestützte Vorhersagen (Predictive Analytics) oder automatisierte Workflows scheitern nicht an der Algorithmik, sondern an der Qualität der Trainingsdaten. Eine saubere Migration ist also keine reine IT-Aufgabe, sondern die fundamentale Voraussetzung für Ihre künftige Wettbewerbsfähigkeit.

Management Summary: Die 3 Säulen einer erfolgreichen Migration

- Data Governance First: Definieren Sie Verantwortlichkeiten (Data Owners) im Fachbereich, bevor Sie Skripte schreiben. Technik folgt Prozess.

- Mut zur Lücke (Löschung): Nutzen Sie die DSGVO als Hebel, um alten Ballast abzuwerfen. Was 10 Jahre nicht genutzt wurde, stiftet keinen Wert, sondern verursacht Kosten und Risiko.

- Investition in ETL: Der Aufwand für Mapping und Transformation wird fast immer unterschätzt. Planen Sie 40-50 % des Projektbudgets allein für die Daten.

Ein valides Datenfundament entscheidet darüber, ob Ihre neue Software-Landschaft als Innovationsmotor fungiert oder zum digitalen Friedhof wird. Der Erfolg Ihrer Migration beginnt jedoch lange vor dem Export – er beginnt mit der Auswahl der richtigen Zielarchitektur, die Ihre Datenstruktur nicht nur aufnimmt, sondern logisch weiterentwickelt. Wenn Sie bereit sind, diesen Weg zu gehen, aber noch validieren müssen, welches Zielsystem Ihre Anforderungen an Skalierbarkeit, API-Offenheit und Datenmodellierung am besten erfüllt, starten Sie Ihre Evaluation auf https://find-your-software.de. Hier finden Sie nicht nur Tools, sondern die strategischen Partner, die Ihre bereinigten Daten verdienen.

Häufig gestellte Fragen (FAQ) zur Datenmigration

Die häufigsten technischen und organisatorischen Fragen, die uns von CIOs und IT-Leitern gestellt werden.

Wie lange dauert eine typische ERP-Datenmigration?

Die Dauer wird fast immer unterschätzt. Für ein mittelständisches Unternehmen (100-500 User) sollten Sie mit 3 bis 6 Monaten reiner Migrationszeit rechnen – parallel zur eigentlichen Software-Implementierung.

Die Zeitfresser sind dabei nicht die Export-Skripte (Technik), sondern die Bereinigung der Stammdaten (Data Cleansing) und die politische Abstimmung der Mapping-Regeln ("Wer entscheidet, welche Kundendaten gelöscht werden?"). Ein "Big Bang" an einem Wochenende erfordert meist 2-3 Monate Vorbereitung für Testläufe (Mock-Cutovers).

Sollte ich historische Bewegungsdaten (Rechnungen, Lieferscheine) migrieren?

In 90 % der Fälle: Nein. Die Migration von abgeschlossenen historischen Transaktionen ist extrem komplex, da sich die Business-Logik (z.B. Steuersätze, Währungen) über die Jahre geändert hat.

Best Practice: Migrieren Sie nur "Open Items" (offene Posten, laufende Verträge) und Stammdaten. Halten Sie das Altsystem in einem "Read-Only"-Modus oder exportieren Sie die Historie in ein Data Warehouse (DWH) oder DMS, um gesetzlichen Aufbewahrungsfristen (GoBD) zu genügen. Das hält das neue System performant und sauber.

Welche Tools empfehlen Sie für den ETL-Prozess?

Die Wahl hängt von der Komplexität ab:

- Enterprise-Level: Talend, Informatica oder MuleSoft. Diese bieten grafische Mapper und Konnektoren für SAP, Salesforce etc.

- Code-Based (Flexibel): Python (Pandas/SQLAlchemy). Ideal für komplexe Transformationen und Data Cleansing, die Standard-Tools nicht abbilden können.

- Vendor-Tools: Nutzen Sie immer die nativen Import-Tools des Zielsystems (z.B. SAP Migration Cockpit), da diese die Business-Logik validieren. Direkte SQL-Inserts in die Zieldatenbank sind ein absolutes Tabu ("Warranty Void").

Wie gehe ich mit der DSGVO bei der Migration um?

Die Migration ist der kritische Punkt für Privacy by Design. Sie dürfen personenbezogene Daten, für die der Zweck entfallen ist (z.B. Bewerberdaten älter als 6 Monate, Ex-Kunden ohne Transaktion seit 10 Jahren), nicht in das neue System übernehmen (Art. 5 DSGVO Datenminimierung).

Implementieren Sie Löschroutinen direkt in die ETL-Strecke. Protokollieren Sie, was nicht migriert wurde ("Deletion Log"), um im Audit nachzuweisen, dass Sie die Daten nicht verloren, sondern bewusst gelöscht haben.

Was ist der häufigste Grund für das Scheitern einer Datenmigration?

Mangelnde Validierung durch den Fachbereich. Wenn die IT meldet "Import erfolgreich" (technisch), bedeutet das nicht, dass die Daten fachlich korrekt sind.

Oft fällt erst Wochen nach dem Go-Live auf, dass z.B. bei der Währungsumrechnung Rundungsfehler auftraten oder Lieferadressen den Rechnungsadressen falsch zugeordnet wurden. Ohne formalen "Sign-Off" durch Data Owner (z.B. Head of Sales) darf kein Go-Live erfolgen.