KI-Funktionen in ERP und CRM: Was genau verbirgt sich eigentlich hinter dem inflationär genutzten Versprechen, dass KI-Funktionen in ERP und CRM Ihre Unternehmensprozesse revolutionieren werden? In der aktuellen Marktsituation stehen IT-Entscheider vor einer Herkulesaufgabe: Sie müssen in komplexen Software-Ausschreibungen die echten architektonischen Innovationen von einem beispiellosen „AI-Washing“-Marketing-Hype unterscheiden. Fast jeder Software-Vendor klebt derzeit hastig das Label „AI-powered“ auf seine Release-Notes, doch oft verbergen sich dahinter lediglich oberflächliche API-Anbindungen an externe Large Language Models (LLMs), die ohne tiefgreifende Integration in den Datenkern des Systems agieren. In einer Zeit, in der die technologische Halbwertszeit von Softwarelösungen rapide sinkt, ist eine tiefgreifende technische Due Diligence kritischer denn je. Es geht nicht mehr nur um Features, sondern um die Frage, ob die zugrunde liegende Infrastruktur – von der Vektordatenbank bis zum Token-Management – für die Anforderungen der nächsten Dekade gerüstet ist. Wenn Sie derzeit Ihre Systemlandschaft evaluieren oder vor einer geschäftskritischen Migration stehen, ist ein fundierter, objektiver Startpunkt unerlässlich. Konsultieren Sie https://find-your-software.de, um eine Vorauswahl von Systemen zu treffen, deren KI-Funktionalitäten tatsächlich auf robusten, semantischen Datenmodellen basieren und nicht nur als teures, latenzanfälliges Chat-Interface auf eine technisch veraltete, monolithische Architektur aufgesetzt wurden.

Die harte Wahrheit der Enterprise-Software im Jahr 2024 lautet: Nicht jede Künstliche Intelligenz ist für jedes transaktionale Problem geeignet. Wir durchleben aktuell eine gefährliche semantische Vermischung von zwei völlig unterschiedlichen Technologie-Stacks. Auf der einen Seite steht das traditionelle Machine Learning (ML) – oft als „Predictive AI“ bezeichnet –, das auf statistischen Verfahren wie Random Forests oder Gradient Boosting basiert. Diese Systeme sparen in der Industrie bereits seit Jahren still und heimlich gigantische Summen ein, indem sie Lieferketten optimieren und Churn-Raten präzise vorhersagen. Auf der anderen Seite steht die Generative AI (GenAI), die zwar in Sales-Präsentationen durch spektakuläre Textgenerierung glänzt, im harten deterministischen Kern eines ERP-Systems – dort, wo es um Cent-genaue Buchungen und physikalische Lagerbestände geht – jedoch massive Risiken durch stochastische Halluzinationen birgt.

Ein architektonischer „Quick Fix“, bei dem ein LLM ungeschützt über ein Web-Interface auf SQL-Datenbanken zugreift (Text-to-SQL), stellt ein enormes Sicherheits- und Compliance-Wagnis dar. Echte Innovation findet nicht im User Interface statt, sondern im Middleware-Layer: Dort, wo Retrieval-Augmented Generation (RAG) sicherstellt, dass die KI nur auf Basis verifizierter Unternehmensdaten antwortet, und wo strikte Guardrails verhindern, dass probabilistische Modelle unkontrolliert in deterministische Buchungsprozesse eingreifen. Dieser umfassende Leitfaden geht über die üblichen Management-Zusammenfassungen hinaus. Wir zerlegen die Architektur moderner Business-Systeme in ihre Einzelteile, analysieren die notwendige Daten-Pipeline für effizientes Inference-Management und trennen die nutzlosen Produktivitäts-Gimmicks von den echten, skalierbaren Renditebringern. Wir zeigen Ihnen detailliert, wie Sie in Ihrem nächsten Request for Proposal (RFP) die richtigen Fragen zu API-Latenzen, Datensouveränität (EU AI Act Compliance) und der Integration von Vektordatenbanken in den bestehenden relationalen Kern stellen, um Ihr Unternehmen vor teuren Fehlinvestitionen zu schützen.

Der Fokus dieses Whitepapers liegt auf der Total Cost of Ownership (TCO) von KI-Integrationen. Wir untersuchen die versteckten Kostenfaktoren, vom Token-Verbrauch bei komplexen RAG-Anfragen bis hin zur notwendigen Datenbereinigung, ohne die selbst das fortschrittlichste Modell wertlose Ergebnisse liefert („Garbage in, Garbage out“). Nur wer versteht, wie die KI-Layer mit der Business Logic des ERPs und CRM verzahnt sind, wird in der Lage sein, eine Systemlandschaft zu sourcen, die echte Wettbewerbsvorteile durch autonome Prozesse generiert, anstatt nur die Cloud-Rechnung des Software-Herstellers in die Höhe zu treiben.

Hier ist das erste Kapitel, technisch massiv vertieft und architektonisch detailliert ausgebaut, um die fundamentale Inkompatibilität und deren Lösung auf Enterprise-Niveau zu beleuchten.1. Der architektonische Konflikt: Deterministische Systeme vs. Probabilistische KI

Um die Tiefe der Herausforderung zu begreifen, müssen wir die ontologische Trennung zwischen klassischer Business-Software und moderner KI verstehen. Ein Enterprise Resource Planning (ERP) System operiert auf einem deterministischen Fundament. Seine gesamte Architektur ist auf ACID-Konformität (Atomicity, Consistency, Isolation, Durability) ausgerichtet. Wenn eine Transaktion in einer relationalen SQL-Datenbank stattfindet, gibt es nur zwei Zustände: Erfolg (Commit) oder Abbruch (Rollback). Wenn Sie 100 Einheiten im Bestand haben und 20 entnehmen, ist das Ergebnis zwingend 100−20=80. Die Finanzbuchhaltung folgt der Logik der doppelten Buchführung – ein mathematisch geschlossenes System, in dem Soll und Haben eine unverrückbare Identität bilden. Es gibt hier keine Nuancen, keine „Konfidenzintervalle“ und absolut keinen Raum für stochastische Variationen.

Im krassen Gegensatz dazu stehen Large Language Models (LLMs) wie GPT-4 oder Gemini. Diese sind in ihrer DNA probabilistisch (wahrscheinlichkeitsbasiert). Ein LLM „versteht“ keine Bilanz und „kennt“ keine Lagerbestände. Technisch gesehen ist ein LLM eine hochkomplexe mathematische Funktion zur Next-Token-Prediction. Basierend auf Milliarden von Parametern in einem neuronalen Netz berechnet es das statistisch wahrscheinlichste nächste Wortfragment. Wenn Sie ein solches Modell fragen: „Wie hoch ist unser Deckungsbeitrag in Region Nord?“, berechnet das Modell nicht den Wert, sondern es generiert eine Antwort, die so klingt, als käme sie von einem Experten. Ohne architektonische Absicherung ist die Antwort eine mathematische Schätzung – im schlimmsten Fall eine Halluzination, die jedoch mit absoluter rhetorischer Überzeugungskraft präsentiert wird.

Die Gefahr des direkten „Text-to-SQL“ ohne Middleware

Ein häufiger Fehler bei hastig entwickelten „AI-Features“ ist der direkte Zugriff der KI auf die Datenbank via Natural Language to SQL. Hierbei übersetzt die KI die Nutzerfrage direkt in eine Datenbankabfrage. Das Risiko ist immens: Ein kleiner semantischer Fehler in der Join-Logik oder eine Fehlinterpretation eines Tabellennamens führt zu faktisch falschen Finanzdaten. In einer Welt von Compliance-Vorgaben (GoBD, SOX, DSGVO) ist ein „fast richtiger“ Lagerbestand oder eine „wahrscheinliche“ Bilanzsumme kein technisches Problem, sondern ein existenzbedrohendes Risiko für das Audit und den testierten Jahresabschluss.

Die Lösung: Layer-Separation und RAG-Architekturen

Seriöse Enterprise-Architekturen lösen diesen Konflikt durch eine strikte Trennung der Verantwortlichkeiten (Separation of Concerns). Die KI wird nicht in den transaktionalen Kern gelassen, sondern fungiert als intelligenter Orchestrator auf einem dedizierten Layer. Der Goldstandard hierfür ist die Retrieval-Augmented Generation (RAG):

- Retrieval-Phase: Wenn ein Nutzer eine Frage stellt, generiert die KI keine Antwort aus ihrem eigenen „Gedächtnis“. Stattdessen triggert das System eine deterministische Suche (SQL oder Vektorsuche) in der Datenbank.

- Augmentation-Phase: Die tatsächlichen Fakten aus der Datenbank werden als unveränderlicher Kontext in den Prompt für die KI eingebettet (sog. „Grounding“).

- Generation-Phase: Die KI erhält nun den strikten Befehl: „Antworte ausschließlich auf Basis der mitgelieferten Datenbankfakten. Wenn die Information nicht enthalten ist, sage, dass du es nicht weißt.“

Zusätzlich werden Guardrails (Schutzplanken) implementiert. Das sind programmierte Validierungsschichten, die den Output der KI gegen die Realität prüfen. Ein Beispiel: Bevor die Antwort dem Nutzer angezeigt wird, prüft ein deterministischer Algorithmus, ob die von der KI genannte Summe tatsächlich mit der Summe in der Datenbank übereinstimmt. Erst durch diese Symbiose aus probabilistischer Eloquenz und deterministischer Präzision wird KI im Enterprise-Umfeld einsatzfähig.

2. Der Hype: Welche KI-Features in Präsentationen glänzen, aber Budgets verbrennen

Lassen Sie uns schonungslos mit den Funktionen aufräumen, die in Vertriebs-Demos auf großen Konferenzen fantastisch aussehen, in der harten Realität des DACH-Mittelstands aber oft scheitern. Das Problem vieler „AI-first“-Versprechen ist die Diskrepanz zwischen statistischer Plausibilität und faktischer Korrektheit. Wer KI-Features einkauft, ohne die zugrunde liegende Daten-Pipeline zu prüfen, investiert oft in teure „Sunk Costs“.

Hype 1: „Chatten Sie mit Ihrem ERP“ (Die Illusion der fehlerfreien NLP-Abfrage)

„Zeige mir alle Kunden, die im dritten Quartal weniger gekauft haben als im Vorjahr, aber ein hohes strategisches Potenzial aufweisen.“ Diese Anfrage klingt nach ultimativer Usability. Technisch verbirgt sich dahinter meist eine Text-to-SQL-Translation. Hier scheitert die KI oft an drei architektonischen Barrieren:

- Join-Komplexität: Enterprise-Datenmodelle bestehen oft aus tausenden Tabellen. Eine Abfrage, die CRM-Daten (Potenzial) mit ERP-Transaktionen (Umsatz) verknüpft, erfordert präzise

JOIN-Operationen über komplexe Primärschlüssel-Beziehungen. Ein LLM „halluziniert“ hier oft Tabellenbeziehungen, die physisch nicht existieren. - Semantischer Drift: Was bedeutet „strategisches Potenzial“ im Code? Ist es ein Feld in der Datenbank, eine berechnete Spalte oder eine subjektive Notiz eines Sales-Managers? Ohne eine Semantic Layer (ein Metadaten-Modell, das Begriffe für die KI übersetzt) rät das System lediglich.

- Token-Burn & Latenz: Die Übersetzung natürlicher Sprache in SQL, die Validierung des Codes und die anschließende Rückübersetzung der Ergebnisse in Text erzeugt eine Latenz, die weit über der eines optimierten Dashboards liegt – bei gleichzeitig hohen Kosten pro API-Call.

Das Urteil: Als Navigationshilfe („Wo hinterlege ich IBAN-Änderungen?“) ist NLP exzellent. Für analytische Aufgaben bleibt ein Semantic BI-Dashboard unschlagbar. Es liefert verifizierte Daten-Cubes, die reproduzierbar und audit-sicher sind.

Hype 2: Vollautonome E-Mail-Generierung im B2B-Vertrieb (Das Risiko der Entfremdung)

Moderne CRMs werben mit autonomen Agenten, die Leads prospektieren und kontaktieren. Während dies im B2C-Volumengeschäft funktioniert, ist es im High-Ticket B2B-Vertrieb brandgefährlich. Ein LLM versteht zwar die Syntax, aber nicht die Beziehungs-Historie.

| Feature | Das Versprechen | Die technische Realität |

|---|---|---|

| Autonomer Versand | Skalierung des Outreaches ohne Personalaufwand. | Gefahr von „Tone-Deafness“. Die KI ignoriert laufende Reklamationen oder persönliche Nuancen aus dem letzten Golf-Treffen. |

| Automatisches Follow-up | Kein Lead wird mehr vergessen. | Massenhafter Versand identisch klingender KI-Prosa führt oft zu direkten Spam-Markierungen und verbrannter Domain-Reputation. |

Das Urteil: Nutzen Sie KI für Summarization (Zusammenfassung von 50 E-Mails vor dem Termin) und Drafting (Entwurf erstellen). Der finale „Send“-Button muss jedoch zwingend in menschlicher Hand bleiben (Human-in-the-loop). Vertrauen ist im B2B die härteste Währung; sie durch einen probabilistischen Algorithmus zu riskieren, ist ökonomisch irrational.

Hype 3: KI-gestützte Strategie-Empfehlungen (Das Black-Box-Dilemma)

„Die KI empfiehlt eine Preissenkung um 5 %, um den Marktanteil zu maximieren.“ Solche Empfehlungen basieren oft auf historischem Pattern-Matching. Das Problem: KI-Modelle sind nativ rückwärtsgerichtet. Sie erkennen Korrelationen in vergangenen Daten, können aber Black-Swan-Events oder makroökonomische Verschiebungen (z. B. neue Zölle, geopolitische Krisen) nicht einpreisen, wenn diese nicht im Trainings-Set enthalten sind.

Fazit für Entscheider: Lassen Sie sich nicht von der Ästhetik des Frontends blenden. Fragen Sie im RFP gezielt nach der Fehlerrate (Error-Rate) bei komplexen Queries und den Mechanismen zur Vermeidung von Bias in Empfehlungs-Engines. Echter Wert entsteht dort, wo KI den Menschen unterstützt, nicht dort, wo sie ihn blind zu ersetzen versucht.

3. Die wahren Gelddruckmaschinen im CRM (Sales, Marketing & Service)

Während Generative AI (GenAI) die mediale Aufmerksamkeit durch spektakuläre Text- und Bildgenerierung monopolisiert, findet die tatsächliche Wertschöpfung im Enterprise-Sektor oft im Stillen statt. Die „wahren Gelddruckmaschinen“ sind spezialisierte Machine-Learning-Modelle (ML), die auf Klassifikation, Regression und Anomalieerkennung optimiert sind. Anders als LLMs arbeiten diese Modelle deterministisch auf strukturierten Datensätzen und nutzen mathematische Frameworks wie XGBoost, Random Forests oder Support Vector Machines (SVM), um Muster in Millionen von Kundeninteraktionen zu identifizieren, die für das menschliche Auge unsichtbar bleiben.

3.1 Predictive Lead Scoring: Von starren Heuristiken zur multidimensionalen Klassifikation

Traditionelles Lead Scoring, wie es in vielen Legacy-CRMs noch zu finden ist, basiert auf linearen, punktbasierten Heuristiken (z. B. „Whitepaper-Download = +10 Punkte“). Dieses Modell ist inhärent fehlerhaft, da es Korrelation mit Kausalität verwechselt und keine Gewichtung von Interdependenzen erlaubt.

Modernes Predictive Lead Scoring hingegen nutzt Supervised Learning. Dabei lernt das Modell aus einem historischen Datensatz (Training Set) erfolgreicher Abschlüsse (Closed Won) und Misserfolge (Closed Lost). Es führt ein automatisches Feature Engineering durch, um Variablen zu identifizieren, die tatsächlich konvertieren.

- Technische Tiefe: Das Modell analysiert nicht nur isolierte Events, sondern die Velocity (Geschwindigkeit der Interaktionen) und die Sequenz der Touchpoints. Wenn ein Lead aus der Fertigungsindustrie an einem Dienstagmorgen eine Pricing-Seite besucht, nachdem er zuvor zwei spezifische Case Studies gelesen hat, berechnet das Modell eine Conversion Probability, die weit über einfachen Punktesystemen liegt.

- Anbieter-Beispiele: Marktführer wie Salesforce mit Einstein AI oder HubSpot (Predictive Lead Scoring) integrieren diese Modelle nativ, um Vertriebsteams direkt die „Hot Leads“ mit dem höchsten Customer Lifetime Value (CLV) zu präsentieren.

Praxis-Case: Churn Prediction & Survival Analysis im B2B-SaaS

Das Szenario: Ein Enterprise-Softwareanbieter verzeichnete eine Fluktuationsrate (Churn) von 15 %. Das Problem war die Daten-Latenz: Maßnahmen wurden erst ergriffen, wenn die Kündigung bereits rechtlich wirksam war.

Die ML-Architektur: Implementierung eines Modells zur Anomalieerkennung (basierend auf Isolation Forests oder Gradient Boosted Trees). Das System integriert Telemetrie-Daten direkt aus der Applikation: 1. Feature: Sinkende API-Calls oder Login-Frequenzen über ein 14-Tage-Intervall (Moving Average). 2. Feature: Häufige Exporte von Stammdaten (Indikator für Systemwechsel-Vorbereitung). 3. Feature: Sentiment-Verfall in Support-Tickets, analysiert via NLP.

Das Resultat: Das CRM generiert einen „At-Risk“-Alarm, bevor der Kunde den Entschluss zur Kündigung festigt. Dies erlaubt „Next Best Action“-Empfehlungen für das Customer Success Team. Solche tiefgreifenden Integrationen zwischen Nutzung und Vertriebsdaten sind essenziell – lesen Sie hierzu mehr über die Vermeidung von Datensilos im find-your-erp.de Blog.

3.2 Intelligentes Service-Automatisierung: NLP-basierte Klassifikatoren

Im Customer Service wird der ROI oft über die First Contact Resolution (FCR) und die Average Handling Time (AHT) definiert. Manuelle Triage (das Lesen und Verteilen von Tickets) ist einer der größten Kostentreiber.

Hier kommen spezifisch trainierte NLP-Klassifikatoren (Natural Language Processing) zum Einsatz, die weit über eine einfache Keyword-Suche hinausgehen. Sie nutzen Transformers oder BERT-Modelle, um die Intention (Intent) und das Sentiment einer Anfrage in Millisekunden zu verstehen.

- Automatisches Routing: Ein Ticket mit der Intention „Zahlungsverzug durch Bankfehler“ und einem „wütenden“ Sentiment wird priorisiert und direkt an einen Senior-Agenten in der Buchhaltung geroutet, statt im allgemeinen Postkorb zu versauern.

- Knowledge Base Injection: Während der Agent das Ticket öffnet, hat die KI bereits die passenden Lösungsartikel aus der Dokumentation extrahiert und als Entwurf vorbereitet.

- Anbieter-Beispiele: Zendesk AI und SAP Service Cloud nutzen diese Technologien, um die Effizienz im Service-Center um bis zu 30 % zu steigern.

3.3 Strategisches Sourcing: Die Datenbasis entscheidet

Der Erfolg dieser ML-Modelle steht und fällt mit der Qualität der historischen Daten. Eine „KI-Einführung“ scheitert fast immer, wenn die Datenbasis fragmentiert oder inkonsistent ist. Bevor Sie also in teure KI-Lizenzen investieren, müssen Sie sicherstellen, dass Ihr CRM und Ihr ERP technisch „sauber“ miteinander kommunizieren.

Eine fundierte Marktanalyse ist hierbei der erste Schritt zur Risikominimierung. Auf find-your-software.de/blog finden Sie detaillierte Leitfäden, wie Sie die technologische Reife Ihrer Anbieter prüfen, um sicherzustellen, dass Sie kein „leeres“ KI-Gehäuse kaufen, sondern ein System, das echte statistische Intelligenz bietet. Auch im HR-Bereich spielt die Datenintegrität für KI-gestützte Analysen eine zentrale Rolle; vertiefende Einblicke bietet hier der Find-Your-HR Blog.

Architektur-Fokus: Fragen Sie Ihren Anbieter nicht „Haben Sie KI?“, sondern „Welche mathematischen Modelle nutzen Sie für das Lead Scoring, wie hoch ist die Präzision (Precision) und der Recall Ihrer Churn-Modelle und können wir eigene Features in das Modell einbringen?“. Nur so sourcen Sie eine Lösung, die tatsächlich als Gelddruckmaschine fungiert.

4. Dynamic Pricing & Intelligentes CPQ: Die algorithmische Maximierung der Bruttomarge

In der klassischen B2B-Welt ist die Preisgestaltung oft das „letzte große Rätsel“. Während Beschaffung und Logistik bis auf die dritte Nachkommastelle optimiert werden, erfolgt die Angebotslegung häufig noch auf Basis von „Bauchgefühl“, veralteten Excel-Listen oder starren Rabattmatrizen, die weder die aktuelle Marktvolatilität noch die individuellen Opportunitätskosten berücksichtigen. Ein intelligentes CPQ-System (Configure, Price, Quote) transformiert diesen Prozess von einer reaktiven Verwaltung hin zu einer proaktiven, mathematischen Optimierung. Das Ziel ist die Überwindung des „Legacy-Pricing“, um in volatilen Märkten agil reagieren zu können. Strategische Tipps zur Auswahl solcher Systeme finden Sie im Find-Your-ERP Blog.

4.1 Der technologische Shift: Von statischen Regeln zu Reinforcement Learning

Herkömmliche CPQ-Lösungen arbeiten regelbasiert: „Wenn Abnahmemenge > 1.000, dann gewähre 5 % Rabatt“. Dieser lineare Ansatz ignoriert die Preiselastizität der Nachfrage, die mathematisch als das Verhältnis der relativen Mengenänderung zur relativen Preisänderung definiert ist:

$$\epsilon_{p} = \frac{\frac{dQ}{Q}}{\frac{dP}{P}}$$Hochentwickelte Systeme nutzen heute Reinforcement Learning (RL). Ein RL-Agent agiert in einer Umgebung (Ihrem Markt), führt Aktionen aus (schlägt Preise vor) und erhält Belohnungen (gewonnene Deals mit hoher Marge). Über Tausende Iterationen lernt das Modell die optimale Policy: Wie hoch kann ich den Preis treiben, ohne die Abschlusswahrscheinlichkeit (Win Probability) unter einen kritischen Schwellenwert fallen zu lassen?

- Datengetriebene Variablen: Die KI korreliert in Echtzeit interne Daten (Lagerbestände, aktuelle Produktionsauslastung, Rohstoffpreise im ERP) mit externen Signalen (Wettbewerbspreise via Web-Scraping, makroökonomische Indizes und saisonale Trends).

- Vermeidung von „Over-Discounting“: Statistiken zeigen, dass Vertriebsteams dazu neigen, unnötig hohe Rabatte zu geben, um „auf Nummer sicher“ zu gehen. Ein intelligentes CPQ-Modul wie PROS Smart CPQ oder Vendavo identifiziert diese „Margen-Lecks“ und gibt präzise Leitplanken (Price Guidance) vor.

4.2 Die architektonische Herausforderung: Das ERP-CRM-Kontinuum

Dynamic Pricing kann niemals als isoliertes Silo funktionieren. Es ist die Königsdisziplin der Systemintegration. Damit die KI einen validen Preis berechnen kann, benötigt sie Zugriff auf den „Single Source of Truth“ der Kosten, der fast ausschließlich im ERP-System liegt. Ohne diese Verzahnung drohen Kalkulationen, die zwar den Kunden freuen, aber die Marge vernichten, da die aktuellen COGS (Cost of Goods Sold) nicht berücksichtigt wurden.

Technische Voraussetzungen für den Erfolg:

- Bidirektionale Echtzeit-APIs: Das CRM (Frontend für den Sales) muss die Kundenhistorie liefern, während das ERP (Backend) die tagesaktuellen Selbstkosten und Kapazitäten bereitstellt. Nur so kann die KI beurteilen, ob ein Eilauftrag aufgrund freier Kapazitäten günstig angeboten werden kann oder aufgrund von Überstundenaufschlägen teurer sein muss.

- iPaaS als Enabler: Für komplexe Landschaften empfiehlt sich der Einsatz einer Integration Platform as a Service, um die Datenströme zu orchestrieren. Wie Sie solche Integrationsprojekte strategisch sourcen, erfahren Sie im Find-Your-Software Blog.

Praxis-Beispiel: Skalierbare Variantenkonfiguration im Maschinenbau

Das Szenario: Ein Hersteller von Spezialpumpen bietet Millionen von Kombinationsmöglichkeiten. Früher dauerte die Kalkulation eines Angebots drei Tage, da die Technik jeden Entwurf manuell auf Machbarkeit und Kosten prüfen musste.

Die KI-Lösung: Durch die Einführung eines intelligenten CPQ-Systems (z. B. Infor CPQ oder Salesforce CPQ), das direkt mit dem Product Configuration Layer des ERPs verknüpft ist, erfolgt die technische Prüfung (Constraint Mapping) und die preisliche Optimierung in Millisekunden.

Der ROI: Die Time-to-Quote sank von 72 Stunden auf 15 Minuten. Gleichzeitig wurde durch ML-gestützte Preisempfehlungen die durchschnittliche Marge um 2,4 % gesteigert, da das System erkannte, dass für bestimmte Spezialkomponenten eine deutlich geringere Preissensitivität am Markt herrschte.

4.3 Sourcing-Strategie: Software oder Ökosystem?

Wenn Sie ein CPQ-System mit KI-Ambitionen evaluieren, sollten Sie weniger auf die grafische Benutzeroberfläche und mehr auf die Model-Transparenz (Explainable AI) achten. Vertriebler werden ein System ablehnen, das ihnen Preise vorgibt, ohne die Logik dahinter (z. B. „basierend auf Wettbewerbsdruck in Region X“) zu erklären.

Nutzen Sie für Ihre Marktanalyse spezialisierte Portale, um Lösungen zu finden, die nachweislich Erfahrung in Ihrer Branche haben. Denken Sie daran: Ein System für den Verkauf von Software-Lizenzen benötigt völlig andere Algorithmen als eines für den Stahlhandel. Auch die Personalkosten für die Implementierung solcher Systeme müssen kalkuliert werden; hierzu bietet der Find-Your-HR Blog wertvolle Ansätze zur Ressourcenplanung in IT-Projekten.

Checkliste für den RFP: Fragen Sie explizit nach der API-Latenz der Preisberechnung und ob das System Look-Ahead-Simulationen beherrscht (z. B. „Was passiert mit meiner Marge, wenn die Energiepreise um 15 % steigen?“). Nur so sichern Sie sich eine Architektur, die nicht nur verwaltet, sondern aktiv Ihren Gewinn schützt.

5. Rendite durch Automatisierung: KI im Maschinenraum des ERPs

Während im CRM die Interaktion mit dem Kunden im Vordergrund steht, fungiert die Künstliche Intelligenz im ERP-System als hochpräziser Taktgeber im „Maschinenraum“ des Unternehmens. Hier liegt der Fokus auf der radikalen Beseitigung manueller Massendaten-Transaktionen und der algorithmischen Optimierung der Supply Chain. Wer hier die richtige Architektur wählt, sieht oft schon im ersten Quartal nach dem Go-Live einen signifikanten Impact auf die operativen Margen und das Working Capital. In einer Zeit von Lieferketten-Volatilität und Fachkräftemangel in der Buchhaltung ist die KI-gestützte Automatisierung kein Luxusgut mehr, sondern eine Überlebensstrategie. Erfahren Sie mehr über die strategische Auswahl solcher Systeme im Find-Your-ERP Blog.

5.1 Touchless Accounting: Von spröder OCR zu semantischen Transformer-Modellen

Die manuelle Erfassung von Eingangsrechnungen gilt in der Finanzbuchhaltung traditionell als Endgegner der Effizienz. Klassische Systeme scheiterten oft an der Varianz der Beleglayouts, da sie auf starren, koordinatenbasierten OCR-Templates (Optical Character Recognition) basierten. Moderne ERP-Suiten – wie etwa SAP S/4HANA Finance oder Microsoft Dynamics 365 Finance – nutzen heute Deep Learning Modelle (speziell Visual Transformers), die Dokumente layout-agnostisch und rein semantisch interpretieren.

Die wahre technologische Exzellenz manifestiert sich jedoch im Automated 3-Way-Matching. Das System vergleicht in Echtzeit:

- Invoice Data: Kopf- und Positionsdaten der extrahierten Rechnung.

- Purchase Order (PO): Die im ERP hinterlegten Bestellkonditionen und Preise.

- Goods Receipt (GR): Die tatsächlich im Lager quittierten Mengen und Qualitätsprüfungen.

Stimmen diese drei Datenpunkte innerhalb definierter Toleranzgrenzen überein, erfolgt ein „Dark Processing“: Die Buchung wird ohne menschliche Interaktion direkt an das Zahlwesen übergeben. Der hochqualifizierte Buchhalter wird vom Datenerfasser zum Exception Manager, der nur noch eingreift, wenn die KI eine signifikante Anomalie (z.B. Preisabweichungen außerhalb der Skonto-Regeln) identifiziert. Tipps zur Vorbereitung Ihrer Datenstrukturen finden Sie im Find-Your-Software Leitfaden.

5.2 Demand Forecasting 2.0: Multivariate Zeitreihenanalyse gegen den Bullwhip-Effekt

Klassische Dispositions-Algorithmen basieren auf dem gleitenden Durchschnitt der Vergangenheit. In einer volatilen Welt führt dies zwangsläufig zu hohen Sicherheitsbeständen oder fatalen Out-of-Stock-Situationen. Moderne KI-Module für die Bedarfsplanung nutzen multivariate Zeitreihenanalysen (z.B. basierend auf XGBoost oder LSTMs – Long Short-Term Memory), die weit über interne Verkaufszahlen hinausgehen.

Der technologische Mehrwert: Diese Modelle führen ein automatisches Feature Engineering durch und integrieren externe Signale:

- Makroökonomische Indizes: Rohstoffpreise, Frachtraten (z.B. Shanghai Containerized Freight Index) und Währungsschwankungen.

- Kontextuelle Daten: Regionale Wetterprognosen (essentiell für Retail & Chemie), Feiertagskalender und sogar Sentiment-Analysen aus Branchennews.

- Das Ergebnis: Ein präziser Propensity-to-Demand Score, der es dem Einkauf erlaubt, Bestellungen präskriptiv auszulösen. Anbieter wie Infor CloudSuite integrieren diese Prognosen direkt in den Materialbedarfsplanung-Lauf (MRP), was die Kapitalbindung im Lager (Dead Stock) drastisch reduziert.

Praxis-Case: Diskrete Fertigung & Predictive Maintenance via IIoT

Das Szenario: Ein mittelständischer Maschinenbauer integriert seine Fertigungsinseln in ein Cloud-ERP, um ungeplante Downtimes zu eliminieren, die pro Stunde Kosten im fünfstelligen Bereich verursachten.

Die KI-Lösung: Über das OPC UA Protokoll werden Vibrationen, Temperaturkurven und die Stromaufnahme der Hauptspindeln im Millisekunden-Takt in den ERP-Data-Lake gestreamt. Ein Machine-Learning-Modell erkennt durch Anomalie-Detektion spezifische Frequenzmuster, die auf einen drohenden Lagerschaden hindeuten – oft Wochen bevor dieser mechanisch hörbar wird.

Der automatisierte Workflow: Das ERP generiert ohne menschliches Zutun einen Serviceauftrag, prüft die Verfügbarkeit der Ersatzteile im Lager, reserviert den Techniker und plant die Reparatur in ein bereits existierendes Rüstzeitfenster ein. Diese „Self-Healing Supply Chain“ ist der Goldstandard moderner Fertigungssysteme.

5.3 Inventory Optimization: Der Weg zum „Self-Driving Warehouse“

Die Lageroptimierung profitiert massiv von Reinforcement Learning Algorithmen. Die KI berechnet nicht nur statische Meldebestände, sondern optimiert kontinuierlich das „Slotting“ (die räumliche Anordnung der Artikel). Durch die Analyse von Pick-Frequenzen und Korrelationen (welche Artikel werden oft zusammen gekauft?) schlägt das System proaktiv Umlagerungen vor, um die Laufwege der Mitarbeiter zu minimieren.

Führende Anbieter wie Oracle NetSuite oder spezialisierte Add-ons nutzen diese Daten, um die Durchlaufzeiten im Lager um bis zu 25 % zu senken. Für Unternehmen, die auch ihre HR-Ressourcen in diesen Logistik-Flow integrieren wollen, bietet der Find-Your-HR Blog wertvolle Ansätze zur KI-gestützten Personaleinsatzplanung.

Architektur-Audit im RFP: Verlangen Sie von ERP-Anbietern den Nachweis über Explainable AI (XAI). Ein Einkäufer wird automatisierte Bestellvorschläge nur akzeptieren, wenn das System transparent darlegt, welche Faktoren (z.B. ein prognostizierter Streik in einem Überseehafen) zu dieser spezifischen Empfehlung geführt haben.

6. Agentic Workflows: Von passiven Copilots zu autonomen Agenten

Wir befinden uns aktuell an einem entscheidenden Wendepunkt der Enterprise-Software-Evolution. Während die erste Welle der Generativen KI primär „Copilots“ hervorbrachte – also assistive Systeme, die auf einen menschlichen Prompt warten, um Texte zusammenzufassen oder Code-Schnipsel zu generieren –, markiert die zweite Welle den Aufstieg der Agentic Workflows. In dieser Architektur ist die KI nicht mehr nur ein Berater am Seitenrand, sondern ein autonomer Akteur, der komplexe, mehrstufige Geschäftsprozesse über Systemgrenzen hinweg eigenständig plant, orchestriert und exekutiert. Für IT-Entscheider bedeutet dies den Übergang von der reinen Effizienzsteigerung hin zur autonomen Prozess-Resilienz.

6.1 Die Architektur der Handlung: Das ReAct-Framework & Tool-Use

Ein KI-Agent unterscheidet sich von einem einfachen Chatbot durch seine Fähigkeit zum Reasoning (Schlussfolgern) und Acting (Handeln). Technisch basiert dies oft auf dem ReAct-Paradigma. Dabei nutzt das Large Language Model (LLM) externe Werkzeuge (APIs), um Informationen zu beschaffen oder Transaktionen in Drittsystemen auszulösen.

Die technischen Komponenten eines Agentic-Systems:

- Der Kern (Planning): Das Modell zerlegt eine komplexe Anweisung (z.B. „Löse das Lieferproblem mit Lieferant X“) in logische Teilschritte.

- Tool-Orchestrierung: Über Frameworks wie LangChain oder Semantic Kernel greift der Agent auf eine „Toolbox“ zu – das können SQL-Abfragen, E-Mail-APIs oder RPA-Bots (Robotic Process Automation) sein.

- Memory (Gedächtnis): Agenten nutzen Short-term Memory (den aktuellen Kontext der Interaktion) und Long-term Memory (historische Daten aus Vektordatenbanken), um konsistente Entscheidungen zu treffen.

6.2 Enterprise-Szenario: Der autonome Supply-Chain-Agent

Ein praxisnahes Beispiel verdeutlicht den massiven ROI-Hebel: Eine automatisierte Statusmeldung informiert das ERP-System über eine Hafenblockade in Asien. Ein Copilot würde diese Info lediglich für den Einkäufer zusammenfassen. Ein Agentic Workflow hingegen agiert proaktiv:

- Analyse: Der Agent identifiziert alle betroffenen Purchase Orders im ERP.

- Recherche: Er prüft über eine API die Bestände in alternativen Lagern und sucht auf Find-Your-Software Blog nach Informationen über alternative Logistikpartner.

- Verhandlung: Er entwirft personalisierte E-Mails an Ersatzlieferanten, fragt Lieferzeiten ab und vergleicht die Konditionen.

- Exekution: Er bereitet eine Umbuchung im ERP vor und legt dem Einkäufer nur noch die finale Entscheidung zur digitalen Signatur vor.

6.3 Governance & Guardrails: Die Zähmung der Agenten

Die größte Hürde für den produktiven Einsatz autonomer Agenten ist das Vertrauen in die Operational Integrity. Ein halluzinierender Agent, der eigenständig Rabatte im CRM gewährt oder Millionenbeträge im ERP anweist, ist ein Albtraum für jede Compliance-Abteilung. Daher erfordern Agentic Workflows strikte Guardrails (Schutzplanken):

- Human-in-the-loop (HITL): Kritische Aktionen (z.B. Zahlungsfreigaben oder Vertragsänderungen) erfordern zwingend eine menschliche Bestätigung.

- Policy Engines: Agenten müssen gegen ein statisches Regelwerk (z.B. OPA – Open Policy Agent) geprüft werden, das ihre Befugnisse auf API-Ebene hart einschränkt.

- Audit-Trails: Jeder Denk- und Handlungsschritt des Agenten muss unveränderlich geloggt werden, um bei Fehlern ein Root-Cause-Inquiry zu ermöglichen.

Strategischer Hinweis: Die API-First Notwendigkeit

Agentic Workflows sind nur so mächtig wie die Schnittstellen, die sie bedienen können. Ein monolithisches Legacy-System ohne granulare REST- oder GraphQL-APIs ist für KI-Agenten blind und taub. Wenn Sie Ihre Architektur für die Agenten-Ära rüsten wollen, ist eine Bestandsaufnahme Ihrer API-Reife unumgänglich. Wertvolle Tipps zur Auswahl konnektiver Systeme finden Sie im Find-Your-ERP Blog.

6.4 Anbieter-Landschaft: Wer liefert echte Agenten?

Der Markt bewegt sich rasant. Salesforce Agentforce positioniert sich bereits als Plattform für autonome Service- und Sales-Agenten. Microsoft treibt mit AutoGen ein Framework voran, das es erlaubt, mehrere spezialisierte Agenten miteinander „diskutieren“ zu lassen, um komplexere Probleme zu lösen (Multi-Agent Systems). Auch im Personalbereich werden Agenten zunehmend für das Onboarding und die Skill-Analyse relevant; mehr dazu erfahren Sie im Find-Your-HR Blog.

Sourcing-Check: Fragen Sie Ihren Anbieter im nächsten RFP nicht nach „KI-Features“, sondern nach der Orchestrierungs-Schicht: „Unterstützt Ihre Architektur Agentic Frameworks wie LangChain, und wie werden Berechtigungen (Scopes) für autonome API-Calls verwaltet?“

7. „Self-Healing Data“: Kontinuierliches Master Data Management (MDM) als strategisches Fundament

Jede KI-Architektur ist in ihrer Leistungsfähigkeit durch die Entropie der zugrunde liegenden Daten limitiert. Unternehmensdaten unterliegen einem permanenten Zerfallsprozess, dem sogenannten Data Decay. Statistiken zeigen, dass Stammdaten ohne aktive Pflege jährlich um etwa 20 bis 25 % an Qualität verlieren – Adressen ändern sich, Firmen fusionieren, steuerliche IDs werden ungültig. Wenn Sie hier nicht ansetzen, wird selbst die teuerste KI-Suite lediglich „Garbage in, Garbage out“ auf einem industriellen Level produzieren. Anstatt jedoch auf punktuelle, kostspielige Datenbereinigungs-Projekte zu setzen, ermöglicht moderne KI den Übergang zum Self-Healing Data Management.

7.1 Die Mathematik der Sauberkeit: Fuzzy Logic & Probabilistic Matching

Klassische MDM-Systeme scheiterten oft an der Starrheit ihrer Regeln. KI-gestützte „Data Watchdogs“ im Hintergrund des ERPs nutzen hingegen unscharfe Logik (Fuzzy Logic) und fortgeschrittene Algorithmen zur Ähnlichkeitsmessung, um Inkonsistenzen in Echtzeit zu identifizieren.

- String-Metriken: Algorithmen wie die Levenshtein-Distanz oder Jaro-Winkler berechnen die minimale Anzahl von Bearbeitungsschritten, um eine Zeichenkette in eine andere zu überführen. So erkennt das System sofort, dass „Müller GmbH“ und „Mueller Gmbh“ mit einer Wahrscheinlichkeit von 98 % dasselbe Unternehmen beschreiben.

- Semantische Deduplizierung: Über Embeddings erkennt die KI auch inhaltliche Dubletten, die syntaktisch völlig unterschiedlich aussehen können (z.B. unterschiedliche Bezeichnungen für das gleiche technische Bauteil).

- Kritische Vorarbeit: Bevor Sie solche Systeme implementieren, ist eine saubere Extraktion aus Ihren Altsystemen zwingend. Vertiefende Informationen hierzu finden Sie im Find-Your-Software Datenmigration Leitfaden.

7.2 External Data Enrichment: Automatisierte Validierung gegen globale Verzeichnisse

Ein „selbstheilendes“ System verlässt sich nicht nur auf interne Logik, sondern nutzt Data Enrichment APIs, um Datensätze aktiv zu vervollständigen und zu verifizieren. Sobald ein neuer Debitor im CRM angelegt wird, triggert die KI im Hintergrund Abgleiche mit externen „Sources of Truth“:

- Handelsregister & Finanzdaten: Automatischer Abgleich von Firmensitz, Vertretungsberechtigten und Umsatzsteuer-IDs über Anbieter wie Dun & Bradstreet oder lokale Handelsregister-Schnittstellen.

- Postalische Integrität: Echtzeit-Validierung von Adressdaten gegen globale Postdatenbanken, um Fehlzustellungen und Retourenkosten proaktiv zu minimieren.

- KYC & AML Compliance: Im Finanzumfeld prüfen KI-Agenten Kundenstämme kontinuierlich gegen Sanktionslisten und politisch exponierte Personen (PEP), was die Compliance-Risiken massiv senkt.

7.3 Der „Human-in-the-Loop“: Vom Datenerfasser zum Data Steward

Die KI heilt den Datensatz entweder vollautomatisch (bei einer Konfidenz von > 99 %) oder flaggt ihn für einen menschlichen Data Steward. Dieser erhält im ERP eine Inbox mit „Heilungsvorschlägen“. Das System präsentiert nicht nur das Problem, sondern direkt die Lösung: „Der Datensatz enthält eine veraltete IBAN; die neue wurde in einer aktuellen E-Mail des Lieferanten identifiziert. Möchten Sie diese übernehmen?“

ROI-Betrachtung: Was kostet ein falscher Datensatz?

Die 1-10-100 Regel des Qualitätsmanagements verdeutlicht den Hebel: Es kostet 1 €, die Daten bei der Erfassung zu prüfen, 10 €, sie später zu bereinigen, und 100 €, mit den Folgen fehlerhafter Daten (falsche Rechnungen, verlorene Leads, Fehlbestellungen) umzugehen. KI-gestütztes MDM setzt bei der ‚1 €‘-Stufe an.

Besonders im Personalwesen ist die Datenqualität kritisch für die KI-gestützte Karriereplanung. Lesen Sie mehr über die Bedeutung sauberer HR-Daten im Find-Your-HR Blog.

7.4 Sourcing-Check: Verfügt das System über eine „Data Governance Engine“?

Wenn Sie ein neues ERP oder CRM evaluieren, prüfen Sie, ob die MDM-Funktionen nur kosmetischer Natur sind oder ob eine echte Governance Engine dahintersteht. Führende Lösungen wie SAP Master Data Governance oder Informatica MDM bieten spezialisierte KI-Layer, die Datenqualität nicht als Zustand, sondern als kontinuierlichen Prozess begreifen.

Architektur-Frage für den RFP: Fragen Sie Ihren Anbieter: „Bietet Ihr System eine native Integration von Vektor-Embeddings für die Identifikation semantischer Dubletten, und welche externen Validierungs-APIs sind über Standard-Konnektoren out-of-the-box angebunden?“ Weitere strategische Tipps zur Systemauswahl finden Sie im Find-Your-ERP Blog.

8. Code-Generierung für ERP-Customizing: Dekonstruktion der Berater-Abhängigkeit

Fast kein komplexes ERP-System der Welt wird zu 100 % im Standard genutzt. Die Realität in DACH-Unternehmen ist geprägt von hochspezifischen Modifikationen, um Wettbewerbsvorteile in der Logistik oder Produktion abzubilden. Systeme wie SAP, Microsoft Dynamics 365 oder Oracle NetSuite müssen daher durch proprietäre Skripte und Frameworks (z.B. ABAP, AL, SuiteScript) erweitert werden. Historisch betrachtet verschlang die Entwicklung und Wartung dieses Custom-Codes durch externe Senior-Berater astronomische Budgets. Mit dem Einzug spezialisierter Large Language Models (LLMs), die auf Milliarden Zeilen Enterprise-Code trainiert wurden, verschiebt sich dieses Machtgefüge fundamental. Erfahren Sie mehr über die langfristige Strategie hinter solchen Systementscheidungen im Find-Your-ERP Blog.

8.1 Der technologische Hebel: Domain-Specific LLMs und Legacy-Refactoring

Moderne KI-Assistenten wie GitHub Copilot, SAP AI Core oder Microsoft Copilot für Business Applications sind heute weit mehr als einfache Autovervollständigungs-Tools. Sie fungieren als bi-direktionale Übersetzer zwischen Business-Anforderungen und proprietärer Syntax.

- Legacy-zu-Cloud Transformation: Einer der größten ROI-Hebel liegt in der automatisierten Analyse von „Spaghetti-Code“ aus 20 Jahren On-Premise-Betrieb. Die KI kann veraltete, monolithische Routinen in moderne, API-basierte Microservices übersetzen. Dies reduziert die technische Schuld (Technical Debt) drastisch.

- Automatisierte Unit-Tests & Dokumentation: Ein chronisches Problem im ERP-Customizing ist die fehlende Dokumentation. KI-Modelle generieren heute in Echtzeit präzise technische Dokumentationen und die dazugehörigen Test-Skripte, was die Stabilität bei System-Updates (Release-Fähigkeit) massiv erhöht.

- Time-to-Market: Interne IT-Teams können Erweiterungen, für die früher externe Teams über Wochen gebucht werden mussten, heute in Tagen realisieren. Die Entwicklungszeit sinkt laut aktuellen Benchmarks oft um 30 bis 45 %.

8.2 Die „No-Code“ Illusion und das Risiko der technischen Entropie

In Vertriebspräsentationen wird oft das Bild gezeichnet, dass Fachabteilungen (Citizen Developers) ihre ERP-Anpassungen nun per „Drag-and-Drop“ oder Natural Language selbst bauen. Dies ist ein gefährlicher Trugschluss. Während einfache Workflows tatsächlich demokratisiert werden, bleibt die Architektur-Integrität eine hochkomplexe Aufgabe.

Die Gefahren von KI-generiertem Code ohne Aufsicht:

- Sicherheitslücken: KI-Modelle können Code generieren, der zwar funktioniert, aber bekannte Sicherheitslücken (z.B. SQL-Injections) enthält, wenn er nicht gegen moderne Security-Frameworks geprüft wird.

- Performance-Degradierung: Ineffiziente Datenbankabfragen (z.B. N+1-Probleme), die von einer KI generiert wurden, können die Systemperformance bei großen Datenmengen in die Knie zwingen.

- Unwartbarkeit: Ohne ein striktes Peer-Review-Verfahren durch menschliche Architekten entsteht eine neue Form von „Black-Box-Software“, die nach dem nächsten Update niemand mehr reparieren kann.

Praxis-Einblick: Effizientes Ressourcen-Sourcing

Unternehmen, die KI zur Code-Generierung einsetzen, verändern ihr Sourcing-Profil. Statt Heerscharen von Junior-Programmierern zu „mieten“, die Standard-Routinen schreiben, investiert man in Senior-Architekten, die KI-generierten Code validieren und die Systemintegrität sichern. Dieser Shift erfordert auch im HR-Bereich neue Ansätze beim Skill-Mapping; wertvolle Tipps hierzu bietet der Find-Your-HR Blog.

8.3 Fazit für den RFP: Fragen zur Developer Experience (DX)

Wenn Sie ein neues ERP-System sourcen, sollten Sie im RFP nicht nur nach den Business-Features fragen, sondern auch nach der Developer Experience (DX) für Ihre IT-Abteilung. Unterstützt das System moderne Integrated Development Environments (IDEs) wie VS Code? Gibt es native Plugins für KI-gestützte Entwicklung?

Die Fähigkeit, das System kosteneffizient anzupassen, ist ein entscheidender Faktor für die Total Cost of Ownership (TCO). Wer hier auf proprietäre, geschlossene Architekturen ohne KI-Unterstützung setzt, zementiert die Abhängigkeit von teuren Spezialberatern für die nächsten 10 Jahre. Weitere Analysen zur Evaluierung der Zukunftsfähigkeit von Software-Anbietern finden Sie im Find-Your-Software Blog.

Strategischer Rat: Nutzen Sie die KI nicht, um Berater zu ersetzen, sondern um deren Rolle zu transformieren. Sourcing-Verträge sollten heute nicht mehr auf „Manntagen für Coding“ basieren, sondern auf Outcomes und Architektur-Qualität. Die KI ist das Werkzeug, das Ihren Experten den Rücken für echte Innovationen freihält.

9. FinOps für KI: Die ökonomische Dekonstruktion der Token-Ökonomie

In der Euphorie über die Möglichkeiten von Generativer KI wird ein fundamentaler architektonischer Paradigmenwechsel oft übersehen: Der Übergang von nahezu kostenfreien Rechenoperationen zu wertbasierten Inferenz-Kosten. Während eine klassische SQL-Datenbankabfrage im ERP lediglich Bruchteile eines Cents an Strom und CPU-Zeit verbraucht, löst jede Anfrage an ein Large Language Model (LLM) eine komplexe Kette von Berechnungen auf teuren GPU-Clustern aus. Ohne eine strikte FinOps-Strategie (Financial Operations) droht die KI-Transformation zu einem unkontrollierbaren Kostentreiber zu werden, der die erzielten Effizienzgewinne schlicht auffrisst. Erfahren Sie mehr über die wirtschaftliche Bewertung von Softwarearchitekturen im Find-Your-ERP Blog.

9.1 Die Token-Falle: Wenn Kontext zum Luxusgut wird

Large Language Models rechnen nicht in Wörtern, sondern in Tokens (statistischen Wortfragmenten). Für IT-Entscheider ist das Verständnis der Token-Ökonomie essentiell, um die TCO (Total Cost of Ownership) zu kalkulieren.

- Input- vs. Output-Kosten: Das Senden von Kontext (z.B. ein 100-seitiges Wartungshandbuch für eine RAG-Abfrage) erzeugt massive Mengen an „Input Tokens“. Da LLMs ein quadratisches Aufwandswachstum in Bezug auf die Kontextlänge aufweisen, steigen die Kosten nicht linear, sondern progressiv.

- Context Window Management: Je größer der „Arbeitsspeicher“ (Context Window) der KI sein muss, um eine komplexe ERP-Analyse durchzuführen, desto teurer wird die Inferenz. Wer hier blind „alles in den Prompt wirft“, verbrennt Kapital ohne qualitativen Mehrwert.

- Latenz-Kosten-Trade-off: Schnellere Modelle (geringe Latenz) sind oft teurer oder funktional eingeschränkter. Eine fundierte Marktanalyse auf dem Find-Your-Software Blog hilft Ihnen, Anbieter zu identifizieren, die ein transparentes Pricing-Modell für diese Ressourcen anbieten.

9.2 Architektonische Effizienz: LLMs vs. SLMs (Small Language Models)

Ein entscheidendes Kriterium in der Vendor Due Diligence ist die Model-Sizing-Strategie des Herstellers. Es ist ökonomischer Wahnsinn, ein gigantisches GPT-4-Modell zu nutzen, um lediglich ein kurzes Support-Ticket zu klassifizieren.

| Modell-Typ | Anwendungsfall | FinOps-Impact |

|---|---|---|

| Large Language Models (LLM) | Komplexe strategische Analysen, kreatives Drafting. | Hochpreisig (Abrechnung meist pro 1k Tokens). |

| Small Language Models (SLM) | Extraktion von Daten aus Rechnungen, Sentiment-Analyse. | Kosteneffizient, oft lokal oder in privaten Instanzen hostbar. |

| Task-Specific Models | Code-Generierung, Übersetzung, Klassifikation. | Bestes Preis-Leistungs-Verhältnis durch Spezialisierung. |

Suchen Sie gezielt nach Anbietern, die Model-Routing einsetzen. Dabei entscheidet eine intelligente Zwischenschicht (Router), welche Anfrage an welches Modell gesendet wird, um die Kosten bei gleichbleibender Qualität zu minimieren.

9.3 Sourcing-Strategie: Transparenz und Preisgarantien fordern

In RFPs müssen Sie von Software-Anbietern Transparenz über die Inferenz-Architektur fordern. Lassen Sie sich nicht mit „AI-Flatrates“ abspeisen, die nach einem Jahr massiv teurer werden.

- Bring Your Own Key (BYOK): Bietet der Anbieter an, dass Sie Ihre eigenen API-Keys (z.B. von Azure OpenAI oder AWS Bedrock) nutzen können? Dies gibt Ihnen die volle Kontrolle über die Kosten und die Wahl des Modells.

- Rate Limiting & Quotas: Verfügt das System über granulare Einstellungsmöglichkeiten, um das Budget pro Abteilung oder User zu deckeln?

- FinOps Frameworks: Orientieren Sie sich an den Standards der FinOps Foundation, um Cloud-Kosten kontinuierlich zu optimieren.

Checkliste für IT-Entscheider: Verlangen Sie eine Teststellung, um den Token-Verbrauch unter Realbedingungen zu messen. Eine KI-Funktion ist nur dann „smart“, wenn sie nicht nur ein technisches Problem löst, sondern auch die wirtschaftlichen Guardrails Ihres Unternehmens respektiert.

10. KI in HR und ESG: Zwischen operativer Effizienz und regulatorischer Compliance

Wenn wir den transaktionalen Kern von ERP- und CRM-Systemen verlassen und uns den hochsensiblen Bereichen Human Resources (HR) und Environmental, Social, and Governance (ESG) zuwenden, verschiebt sich die Bewertungsmatrix für KI-Investitionen fundamental. Während im Vertrieb eine Fehlprognose „nur“ Marge kostet, führen algorithmische Fehler in HR oder ESG zu massiven rechtlichen Konsequenzen, Reputationsschäden und dem Verstoß gegen EU-weite Richtlinien. Hier trifft rohe algorithmische Effizienz auf das Konzept der Ethical AI. Strategische Leitfäden zur Auswahl konformer Systeme finden Sie regelmäßig im Find-Your-Software Blog.

10.1 Das rechtliche Minenfeld: KI im Recruiting und Talent Management

Das Versprechen vieler HR-Tech-Anbieter klingt verlockend: „Automatisieren Sie Ihr Sourcing und lassen Sie unsere KI die 5.000 Lebensläufe nach den ‚Top 10‘-Kandidaten filtern.“ Technisch gesehen ist dies ein Klassifizierungsproblem. Doch genau hier verbirgt sich das Risiko des Algorithmic Bias.

- Das Bias-Dilemma: Algorithmen sind nicht objektiv; sie sind Spiegelbilder ihrer Trainingsdaten. Wenn ein Unternehmen in den letzten 20 Jahren unbewusst bestimmte Demografien bevorzugt hat, lernt das Machine-Learning-Modell diese Muster als „Erfolgskriterien“. Ein unreguliertes Modell könnte so Kandidaten aufgrund von Wohnort, Alter oder Geschlecht diskriminieren, ohne dass ein Mensch dies explizit programmiert hat.

- Der EU AI Act: Unter der neuen EU-Verordnung wird KI im Personalwesen (Recruiting, Beförderung, Leistungsbewertung) als Hochrisiko-System eingestuft. Dies erfordert strikte Dokumentationspflichten, Risikomanagement-Systeme und eine nachweisbare Human Oversight.

- Explainable AI (XAI) in HR: Sourcing-Entscheider müssen von Anbietern fordern, dass die KI-Entscheidungen transparent begründet werden. Ein „Black Box“-Scoring ist rechtlich nicht mehr haltbar. Erfahren Sie mehr über die Auswahl rechtssicherer HR-Software im Find-Your-HR Blog.

Der legale ROI in HR: Konzentrieren Sie KI-Investitionen auf administrative Assistenz und Personalentwicklung. KI-gestütztes Skill-Gap-Mapping (welche Kurse braucht ein Mitarbeiter für das nächste Karrierestufe?) oder die Optimierung komplexer Schichtpläne unter Berücksichtigung von Tarifverträgen und Mitarbeiterwünschen bieten enorme Renditen ohne diskriminierende Risiken.

10.2 Die gesetzliche Notwendigkeit: KI als Enabler für CSRD und ESG-Reporting

Während KI in HR oft ein „Kann“ (mit Risiken) ist, wird sie im Bereich ESG zum „Muss“. Die Corporate Sustainability Reporting Directive (CSRD) zwingt Unternehmen zur lückenlosen Offenlegung ihrer CO2-Bilanzen – inklusive der hochkomplexen Scope-3-Emissionen (indirekte Emissionen in der Lieferkette). Die manuelle Erfassung dieser Datenberge ist ohne algorithmische Unterstützung ökonomisch nicht darstellbar.

- Technischer Prozess (NLP & NER): Moderne ESG-Module nutzen Natural Entity Recognition (NER), um unstrukturierte Daten aus Frachtbriefen, Stromrechnungen und Lieferantenerklärungen zu extrahieren. Das System erkennt automatisch, ob es sich um Kilowattstunden, Tonnenkilometer oder Liter Diesel handelt.

- Automatisches Mapping: Diese Rohdaten werden über Machine-Learning-Algorithmen mit globalen Emissionsfaktoren-Datenbanken (z. B. Ecoinvent oder Gemis) abgeglichen. Die KI übernimmt hier die komplexe Zuordnung von Artikeln zu ihren jeweiligen ökologischen Fußabdrücken.

- Echtzeit-Monitoring: Statt eines statischen Jahresberichts ermöglichen KI-Dashboards ein kontinuierliches Monitoring der Nachhaltigkeitsziele. Dies erlaubt es dem Einkauf, proaktiv Lieferanten mit besseren CO2-Werten zu bevorzugen.

ROI-Fokus: Vom Kostenfaktor zum Wettbewerbsvorteil

Unternehmen, die ihr ESG-Reporting automatisieren, sparen nicht nur bis zu 70 % der Zeit im Controlling, sondern verbessern auch ihr Rating bei Finanzdienstleistern. Ein transparentes, KI-gestütztes ESG-Profil senkt die Kapitalkosten und sichert den Zugang zu grünen Krediten. Für eine tiefergehende Marktanalyse spezialisierter Nachhaltigkeits-Software besuchen Sie das Portal Find-Your-ESG.

10.3 Fazit für das Sourcing: Die „Compliance-First“-Strategie

Beim Sourcing von KI-Komponenten für HR und ESG müssen Sie die technologische Reife mit der regulatorischen Sicherheit gewichten. Fordern Sie im RFP Nachweise über Bias-Audits und die Einhaltung der ISO/IEC 42001 für KI-Managementsysteme. Ein Anbieter, der keine klare Antwort auf die Anforderungen des EU AI Acts hat, stellt ein langfristiges Haftungsrisiko für Ihr Unternehmen dar. Weitere Einblicke in die Architektur integrierter ERP- und ESG-Landschaften bietet der Find-Your-ERP Blog.

Checkliste für Entscheider: Lassen Sie sich zeigen, wie das System mit „unvollständigen Daten“ in der Lieferkette umgeht. Nutzt es statistische Durchschnittswerte (Schätzungen) und flaggt diese als solche? Transparenz über die Datenherkunft (Data Lineage) ist in HR und ESG das wichtigste Feature überhaupt.

11. Technische Architektur: Wie Sie KI-Readiness im RFP wirklich prüfen

Künstliche Intelligenz ist kein simples Plugin, das man „einfach mal installiert“ oder über ein bestehendes System stülpt. Wahre KI-Exzellenz ist eine Frage der Back-end-Sanierung. Sie erfordert ein absolut solides Fundament aus extrem sauberen, vernetzten und vor allem semantisch erschlossenen Daten. Wenn Sie heute eine neue Unternehmenssoftware ausschreiben, müssen Sie die „KI-Readiness“ der Architektur knallhart abfragen – auch wenn Sie die eigentlichen KI-Features erst in Phase 2 oder 3 Ihres Digitalisierungsplans aktivieren wollen. Ein System, das heute keine KI-Infrastruktur mitbringt, ist in drei Jahren bereits technisches Legacy. Strategische Leitfäden zur langfristigen Architekturplanung finden Sie im Find-Your-ERP Blog.

11.1 Vektor-Datenbanken & Semantic Search: Der Treibstoff für RAG

Wenn ein Anbieter stolz von „Generativer KI“ und „Unternehmenswissen“ spricht, müssen Sie nach der technischen Umsetzung der Retrieval-Augmented Generation (RAG) fragen. Ein seriöses Enterprise-System für unstrukturierte Daten (Handbücher, Verträge, E-Mails) nutzt heute keine einfache Volltextsuche mehr, sondern Vektor-Datenbanken (wie Pinecone, Milvus, pgvector oder Weaviate).

- Vektor-Embeddings: Ihre Unternehmensdaten werden dabei nicht als Text, sondern als hochdimensionale mathematische Vektoren gespeichert. Diese „Embeddings“ erfassen die semantische Bedeutung. Nur so versteht das System, dass eine Anfrage zu „Zahlungszielen“ auch Dokumente über „Skonto-Fristen“ finden muss.

- Halluzinations-Prävention: Fragen Sie gezielt: „Wie stellen Sie sicher, dass das LLM ausschließlich auf Basis unserer Vektor-Suche antwortet (Grounding)?“ Ein System ohne dedizierten Vektor-Index neigt im Enterprise-Kontext zu gefährlichen Erfindungen.

- Sourcing-Hinweis: Achten Sie darauf, ob diese Technologie nativ im Stack enthalten ist oder über teure Drittanbieter-Lizenzen nachgerüstet werden muss. Weitere Details zur Marktanalyse moderner Stacks bietet der Find-Your-Software Blog.

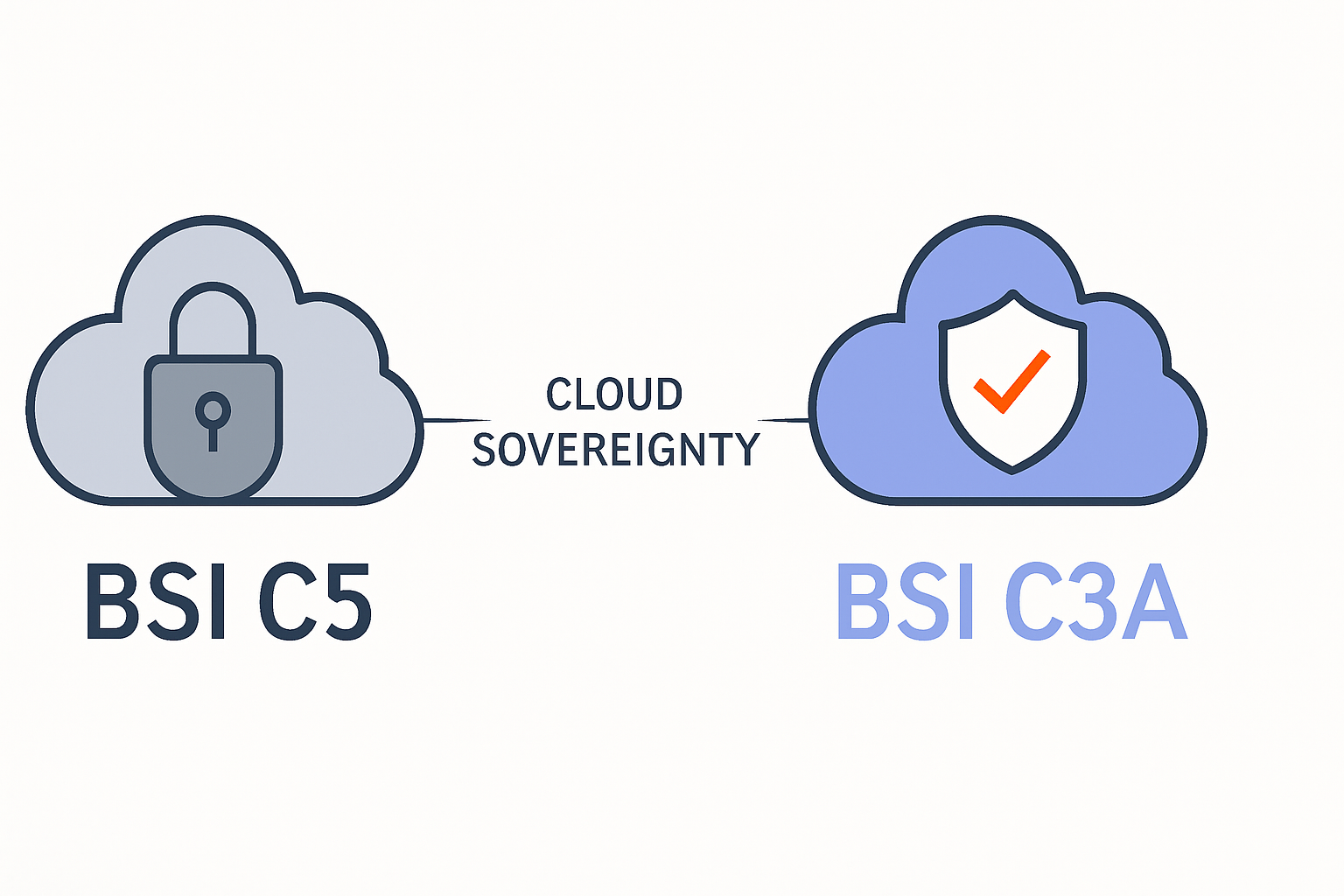

11.2 Data Governance & Isolation: Souveränität im DACH-Raum

Das kritischste Kriterium im europäischen Raum ist die Datensouveränität. Viele US-basierte SaaS-Lösungen haben in ihren AGB Klauseln versteckt, die es ihnen erlauben, anonymisierte Kundendaten zur Verbesserung ihrer globalen Modelle zu nutzen. Im Enterprise-Umfeld ist das ein absolutes K.O.-Kriterium.

- Zero Data Retention (ZDR): Fordern Sie eine vertragliche Garantie, dass das LLM (z.B. via Azure OpenAI oder AWS Bedrock) Ihre Prompts verarbeitet, sie aber niemals speichert oder für das Training von Basismodellen verwendet.

- Tenant Isolation: Die KI-Infrastruktur muss auf der Ebene Ihres Mandanten (Tenants) isoliert sein. Ihre „Vektor-Verschläge“ dürfen niemals mit denen anderer Kunden vermischt werden, um Cross-Tenant-Information-Leaks zu verhindern.

- Compliance: Prüfen Sie, ob das System bereits die Anforderungen des EU AI Acts erfüllt, insbesondere hinsichtlich der Transparenz und Risikobewertung.

11.3 Open Ecosystem & BYOM: Der Schutz vor dem Goldenen Käfig

Vermeiden Sie den totalen Vendor-Lock-in bei KI-Modellen. Die Entwicklung im Bereich der Large Language Models ist so rasant, dass das „beste Modell“ von heute morgen bereits obsolet sein kann. Eine zukunftssichere Architektur muss Modell-agnostisch sein.

- Bring Your Own Model (BYOM): Erlaubt die Architektur, eigene, proprietäre Machine-Learning-Modelle über standardisierte APIs (z.B. REST, gRPC) einzubinden? Dies ist entscheidend, wenn Ihre eigenen Data Scientists spezifische Modelle via scikit-learn, PyTorch oder TensorFlow entwickelt haben.

- Orchestrierungs-Layer: Nutzen Sie Systeme, die über einen Abstraktions-Layer (wie LangChain oder LlamaIndex) verfügen. Dies erlaubt es Ihnen, das zugrunde liegende LLM (z.B. Wechsel von GPT-4 auf Claude 3 oder ein lokales Llama-3) auszutauschen, ohne die gesamte Business-Logik neu programmieren zu müssen.

- Interoperabilität: Wie nahtlos fließen Daten zwischen HR-KI und ERP-Kern? Ein integrierter Ansatz ist hier oft effizienter; lesen Sie dazu mehr im Find-Your-HR Blog.

Checkliste für Systemarchitekten im RFP:

- Data Lineage: Kann das System für jede KI-generierte Antwort die exakte Quelle im ERP/CRM nachweisen (Zitierfähigkeit)?

- Metadata Strategy: Wie werden Metadaten (z.B. Berechtigungen auf Feldebene) an die KI übergeben, damit Nutzer keine Informationen sehen, für die sie keine SQL-Rechte hätten?

- Inference Latency: Welche SLAs garantiert der Anbieter für die Antwortzeiten der KI-Services unter Volllast?

Fazit für die Ausschreibung: Kaufen Sie keine „schwarze Kiste“. Verlangen Sie ein detailliertes Architecture Diagram der KI-Komponenten. Nur ein Anbieter, der bereit ist, seinen „KI-Maschinenraum“ offenzulegen, ist ein verlässlicher Partner für Ihre digitale Transformation. Weitere Unterstützung bei der Erstellung technischer RFPs finden Sie auf den Fachportalen von Find-Your-Software.

12. Die ROI-Kalkulation: Die Spreu vom Weizen trennen – Ein mathematisches Framework

Wie bewerten Sie die oft hochpreisigen KI-Angebote der Softwarehersteller objektiv? In der Praxis scheitern viele KI-Projekte nicht an der Technik, sondern an einer mangelhaften ökonomischen Validierung. Um den Return on Investment (ROI) seriös zu berechnen, müssen Sie den Blick von der reinen Feature-Liste weg hin zur Total Value of Ownership (TVO) lenken. Ein professionelles Sourcing erfordert eine harte, metrikgetriebene Entscheidungsmatrix, die sowohl die operativen Einsparungen als auch die strategischen Opportunitätsgewinne quantifiziert. Weitere vertiefende Analysen zur wirtschaftlichen Bewertung komplexer IT-Landschaften finden Sie im Find-Your-ERP Blog.

12.1 Die multidimensionale Entscheidungsmatrix

Nutzen Sie die folgende Matrix als Grundlage für Ihre nächste Vorstandsvorlage. Sie unterscheidet zwischen dem medialen „Rauschen“ (Hype) und der tatsächlichen prozessualen Schlagkraft:

| KI-Funktion | Architektur-Typ | Hype-Faktor | Echter Business Value & KPI-Messung |

|---|---|---|---|

| Automated Invoice Processing | Computer Vision + Transformers | Niedrig |

Massiv. Reduziert die Cost-per-Invoice um bis zu 80%. KPI: Steigerung der „Touchless Posting Rate“ und drastische Reduktion der Durchlaufzeit (Cycle Time) von Rechnungseingang bis zur Skonto-optimierten Zahlung. |

| Chatbasierte ERP-Abfragen | GenAI (LLM) mit RAG | Extrem Hoch |

Gering bis Mittel. Der Wert liegt primär in der User Adoption und der Onboarding Velocity neuer Mitarbeiter. KPI: Reduktion der Support-Tickets für Systemfragen und Senkung der Schulungskosten pro Mitarbeiter. Achtung: Token-Kosten gegen Zeitersparnis gegenrechnen! |

| Predictive Lead Scoring | Gradient Boosted Trees (ML) | Mittel |

Sehr Hoch. Optimiert die Sales Velocity durch Fokussierung auf hochkonvertierende Leads. KPI: Erhöhung der Win-Rate und Senkung der Customer Acquisition Cost (CAC). Messbar über den F1-Score des Modells im Vergleich zu manuellen Systemen. |

| Dynamic Pricing / CPQ | Reinforcement Learning | Mittel |

Hoch. Verhindert „Margen-Erosion“ durch unkontrollierte Rabatte. KPI: Steigerung der durchschnittlichen Bruttomarge (Gross Margin) pro Deal und Reduktion der Time-to-Quote. |

| Demand Forecasting | LSTM / Prophet (Deep Learning) | Niedrig |

Massiv. Direkter Einfluss auf den Cashflow durch Bestandsoptimierung. KPI: Reduktion des Safety Stock und Minimierung des MAPE (Mean Absolute Percentage Error) in der Bedarfsplanung. |

| Agentic Workflows | Multi-Agent Orchestration | Hoch |

Sehr Hoch (Zukünftig). Ermöglicht die vollständige Automatisierung von End-to-End-Prozessen (z.B. Reklamationsmanagement). KPI: Senkung der Cost-per-Transaction und Steigerung der Prozess-Skalierbarkeit ohne linearen Personalaufbau. |

12.2 Evaluierung der Modell-Performance: Precision vs. Recall

Ein häufiger Fehler bei der ROI-Berechnung ist das Ignorieren der statistischen Güte. Wenn ein Anbieter von „90% Genauigkeit“ spricht, fragen Sie nach der Confusion Matrix. Im Enterprise-Sektor ist ein Modell, das viele „False Positives“ produziert (z.B. eine KI, die ständig korrekte Rechnungen als Betrug flaggt), oft teurer als gar keine KI, da die manuellen Korrekturaufwände den Nutzen neutralisieren. Details zur qualitativen Bewertung von Software-Algorithmen finden Sie im Find-Your-Software Blog.

12.3 Risiko-Management und Zertifizierungen

Fordern Sie in Ihren RFPs zwingend Nachweise über Zertifizierungen wie die ISO/IEC 42001 (Artificial Intelligence Management System). Diese Norm ist der globale Benchmark für vertrauenswürdige KI. Sie garantiert, dass der Anbieter:

- Ein systematisches Risikomanagement für KI-Modelle implementiert hat.

- Die Transparenz und Erklärbarkeit (Explainability) der Algorithmen sicherstellt.

- Ethische Leitplanken gegen Algorithmic Bias (Voreingenommenheit) fest verankert hat – ein Thema, das besonders im Personalwesen geschäftskritisch ist, wie im Find-Your-HR Blog detailliert erläutert wird.

Warnung: Die Kosten der „Inference“

Vergessen Sie bei der ROI-Kalkulation niemals die laufenden Betriebskosten (Inference Costs). Während traditionelle Software einmalige Lizenzkosten verursacht, hängen die Kosten bei GenAI oft direkt vom Volumen ab. Ein „kostenloses“ Feature kann bei intensiver Nutzung durch 10.000 Mitarbeiter schnell ein sechsstelliges Monatsbudget an Token-Gebühren verschlingen.

Strategisches Fazit: Wahre Rendite durch KI entsteht nicht durch „Add-ons“, sondern durch die fundamentale Neugestaltung von Prozessen. Suchen Sie nach Partnern, die nicht nur eine „AI-Vision“ verkaufen, sondern die mathematische Reife ihrer Modelle durch Referenzprojekte und harte Benchmarks belegen können. Nutzen Sie Portale wie Find-Your-Software, um die Anbieter zu identifizieren, die den „Value“ vor den „Hype“ stellen.

Fazit: Ignorieren Sie das Frontend, prüfen Sie das Backend

Der erfolgreichste und profitabelste Einsatz von Künstlicher Intelligenz im Enterprise-Umfeld ist keine Frage der Ästhetik, sondern der architektonischen Tiefe. Wahre Intelligenz ist in der Unternehmenssoftware oft völlig unsichtbar. Sie manifestiert sich nicht in blinkenden Chat-Fenstern, bunten Dashboards oder sprechenden Avataren, sondern in reibungslosen, autonomen Prozessen im Hintergrund. Wir sprechen hier von der „Background Orchestration“: Eine Eingangsrechnung, die via Computer Vision semantisch erfasst und ohne menschliches Zutun dunkel verbucht wird. Eine CNC-Maschine, die über IIoT-Sensorik ihr eigenes Verschleißteil bestellt, Wochen bevor ein mechanischer Defekt die Produktion lähmt. Ein Vertriebler, der seine kostbare Zeit nicht mit Kaltakquise verschwendet, sondern exakt weiß, welcher Key-Account heute eine Abschlusswahrscheinlichkeit von über 85 % aufweist, weil die prädiktiven Algorithmen es belegen.

Lassen Sie sich bei Ihren Software-Evaluationen nicht von glänzenden Generative-AI-Gimmicks blenden. Diese oberflächlichen Integrationen bergen oft signifikante rechtliche Risiken (EU AI Act Compliance) und unkalkulierbare finanzielle Belastungen durch explodierende Token-Kosten, ohne einen nachhaltigen Business Value zu generieren. Die echten Renditebringer liegen in der tiefen, algorithmischen Verarbeitung Ihrer strukturierten Unternehmensdaten. Eine KI ist am Ende immer nur so intelligent, präzise und verlässlich wie das ERP- und CRM-Fundament, auf dem sie ruht. Ohne eine saubere Datenextraktion und eine performante API-Schicht bleibt jede KI-Anwendung eine isolierte Spielerei.

Ihre Strategie für die nächste Software-Generation

Bevor Sie gigantische Budgets für vermeintliche Wundersoftware freigeben, prüfen Sie Ihre digitale Basis. Der Weg zur „AI-Ready Company“ führt über drei entscheidende Schritte:

- Daten-Souveränität: Stellen Sie sicher, dass Ihre Datenmodelle sauber, dedupliziert und semantisch erschlossen sind. Lesen Sie dazu unseren Leitfaden zur Datenqualität im Find-Your-Software Blog.

- Architektur-Integrität: Wählen Sie Systeme, die KI nicht als Add-on, sondern als nativen Bestandteil ihrer Business Logic begreifen. Ein fundierter Vergleich von Systemarchitekturen ist hierfür unerlässlich – nutzen Sie die Expertise im Find-Your-ERP Blog.

- Menschzentrierte Transformation: Implementieren Sie KI dort, wo sie den Menschen von repetitiven Aufgaben entlastet, und achten Sie besonders im Personalwesen auf ethische Leitplanken, wie im Find-Your-HR Blog beschrieben.

Starten Sie Ihren Evaluierungsprozess methodisch und faktenbasiert auf Find-Your-Software. Identifizieren Sie gezielt die Anbieter, deren Software-Architektur echte Machine-Learning-Innovationen nicht nur als oberflächliche Marketingfolie nutzt, sondern tief im Quellcode verankert hat. In der Ära der Künstlichen Intelligenz gewinnt nicht das Unternehmen mit dem schönsten Chatbot, sondern das mit dem intelligentesten Backend.

Ihr nächster Schritt: Erstellen Sie eine „KI-Gap-Analyse“ Ihrer aktuellen Systemlandschaft. Welche Prozesse laufen noch deterministisch-manuell, die längst probabilistisch-automatisiert sein könnten? Die Antwort darauf ist der erste Baustein Ihrer zukünftigen Wettbewerbsfähigkeit.

Häufig gestellte Fragen (FAQ) zu KI in Business-Software

Was ist der architektonische Unterschied zwischen Machine Learning und Generative AI im ERP?

Machine Learning (ML) basiert auf diskreter Mathematik und Statistik. Es nutzt strukturierte Daten, um Muster zu erkennen und Regressions- oder Klassifikationsaufgaben zu lösen (z.B. Absatzprognosen oder Credit Scoring). ML liefert deterministische Wahrscheinlichkeiten für spezifische Werte.

Generative AI (GenAI/LLMs) hingegen basiert auf Transformer-Architekturen und „Attention“-Mechanismen. Sie generiert unstrukturierte Inhalte (Text, Code) durch stochastische Vorhersage des nächsten Tokens. Im ERP dient GenAI primär als semantische Brücke (Copilot) zwischen Mensch und Maschine, während ML die algorithmische Optimierung im Hintergrund übernimmt.

Wie schütze ich meine sensiblen Unternehmensdaten vor den Modellen der KI-Anbieter?

Sicherheit beginnt beim Vertrag und endet in der Architektur. Fordern Sie eine Zero Data Retention (ZDR) Policy: Der Anbieter darf Ihre Daten verarbeiten, aber nicht speichern oder zum Training seiner globalen Basismodelle nutzen. Technisch sollten Sie auf Private Tenants in der Cloud setzen oder hybride Architekturen wählen, bei denen die sensiblen Daten via VPC (Virtual Private Cloud) isoliert bleiben. Prüfen Sie zudem, ob der Anbieter BYOK (Bring Your Own Key) für die Verschlüsselung der Vektor-Datenbanken unterstützt.

Warum halluzinieren KIs bei Finanzdaten, und wie wird dies im Enterprise-Umfeld verhindert?

LLMs besitzen kein Verständnis für Fakten oder Logik; sie berechnen lediglich Wort-Wahrscheinlichkeiten. In einem ERP wird dies durch Retrieval-Augmented Generation (RAG) unterbunden. Dabei generiert die KI die Antwort nicht aus ihrem „Gedächtnis“, sondern erhält erst nach einer Datenbankabfrage (SQL oder Vektorsuche) die echten Fakten als Kontext („Grounding“). Strikte Guardrails im Middleware-Layer validieren den Output zudem gegen die deterministischen Werte der Datenbank, bevor der Nutzer die Antwort sieht.

Was sind „Agentic Workflows“ und welchen Einfluss haben sie auf die Prozessautomatisierung?

Agentic Workflows markieren den Übergang vom assistierenden „Copilot“ zum autonomen „Agenten“. Ein Agent kann komplexe Ziele (z.B. „Löse die Lieferverzögerung für Auftrag 456“) in Teilschritte zerlegen, eigenständig System-APIs aufrufen, Daten in Drittsystemen recherchieren und Handlungen ausführen. Dies ermöglicht eine End-to-End-Automatisierung, erfordert jedoch eine extrem reife API-Landschaft und strikte Berechtigungskonzepte (Scopes), um unkontrollierte Systemzugriffe zu vermeiden.

Welche Auswirkungen hat der EU AI Act konkret auf den Einsatz von KI in HR-Systemen?

Der EU AI Act stuft KI-Anwendungen im Personalbereich (Recruiting, Beförderung, Leistungsbewertung) als Hochrisiko-Systeme ein. Unternehmen müssen sicherstellen, dass diese Systeme transparent sind (Explainability), bias-frei arbeiten und eine menschliche Aufsicht (Human Oversight) jederzeit intervenieren kann. Anbieter müssen technische Dokumentationen und Risikomanagement-Systeme vorweisen können. Ein bloßes „Black Box“-Scoring von Bewerbern ist rechtlich unzulässig.

Wie lassen sich die versteckten Kosten von KI-Funktionen (FinOps) kalkulieren?

KI-Kosten sind volumensabhängig (Token-basiert). Kalkulieren Sie nicht nur die Lizenzgebühr, sondern auch die Inference-Kosten. Ein RAG-System, das bei jeder Anfrage hunderte Seiten Dokumentation als Kontext lädt, erzeugt hohe „Input Token“-Kosten. Suchen Sie nach Anbietern, die Small Language Models (SLMs) für einfache Aufgaben nutzen oder Caching-Strategien für Prompts implementieren, um den API-Verbrauch zu deckeln.

Wie erkenne und verhindere ich „Algorithmic Bias“ in meinen Systemen?

Bias entsteht durch voreingenommene Trainingsdaten. Um dies zu verhindern, müssen Anbieter Bias-Audits durchführen und Techniken wie Synthetic Data Generation oder Fairness Constraints einsetzen. Als Nutzer sollten Sie auf Explainable AI (XAI) setzen: Das System muss begründen, warum es zu einem Ergebnis gekommen ist, damit menschliche Auditoren unfaire Muster identifizieren können.